서론

선행연구

연구 방법

1. 데이터 설명

2. 컴퓨터 비전 기반의 차량-보행자 간 잠재적 충돌 위험 인식 방법

분석 결과

1. 도로 이용자의 행동 특징 추출 정확도 평가

2. 보행자 잠재 위험 상황 평가

결론

서론

매년 전 세계적으로 교통사고로 인해 사망하는 사망자의 수는 약 120만 명이며 부상자의 수는 약 5천만 명에 달한다(Lytras and Visvizi, 2018; Akhter et al., 2019). 이 중에서도 교통사고에 가장 취약한 도로 이용자는 단연 보행자이며(Ferranti et al., 2019), WHO(World Health Organization)의 보고서에 따르면, 보행자는 횡단보도를 건널 때 교통사고에 가장 취약하며(Boufous et al., 2016), 특히, 비신호횡단보도의 횡단은 무단횡단을 하는 것만큼이나 위험한 것으로 나타났다(Yang and Ning, 2015). 따라서, 횡단보도에서 보행자의 안전성 개선을 위한 방안이 필요하며, 국내·외적으로 횡단보도에서의 보행자 사고 및 충돌 위험성을 줄이기 위한 연구가 활발히 진행 중이다.(Kim et al., 2011a; Kim et al., 2005).

그중 일부로서, 횡단보도 영역 내에서 차량과 보행자의 충돌 및 그 위험도를 감소시킬 방안을 찾고, 이에 영향을 미치는 요인을 파악하는 연구를 꼽을 수 있다(Gandhi and Trivedi, 2007; Gitelman et al., 2012). 그러나, 이러한 접근 방법은 실제 발생한 교통사고만을 그 대상으로 하므로, 관찰된 교통사고 외의 횡단보도에서의 차량과 보행자의 충돌 위험 상황(비사고 위험 상황)에 대한 고려가 충분히 이루어지지 않는다. 또한, 교통사고 발생 수가 적어 사고 발생에 영향을 주는 요인들이 부정확할 가능성이 존재한다. 이러한 문제의 극복을 위해서 Kim et al.(2011b), Park et al.(2021), Oh et al.(2007a), Oh et al.(2007b)에서는 카메라 영상을 이용한 접근 방법을 채택하여, 차량과 보행자의 잠재적인 충돌 위험 상황을 인식하고, 이에 영향을 주는 요인을 찾는 연구를 수행하였다. 그러나, 영상 기반 연구의 특성상, 영상 내 도로 이용자(차량, 보행자 등)의 탐지와 행동 정보 추출 등의 일련의 작업을 수작업으로 진행하기에, 이러한 충돌 위험 상황을 효율적이고 정확하게 인식 및 분석하기에 어려움이 있으며, 또한, 이러한 방법론을 도시 내 횡단보도에 광범위하게 적용하기 어려운 상황이다.

본 연구에서는 언급한 문제점을 해결하고, 횡단보도 영역에서의 잠재적 충돌 위험 분석을 위한 새로운 형태의 시스템을 제안하고, 이를 도시 내 여러 횡단보도에 실적용하여 그 분석을 수행하고자 한다. 이를 위해, 폐쇄회로 텔레비전(Closed-Circuit Television, CCTV) 카메라 영상으로부터 컴퓨터 비전 기반의 방법론을 이용하여 차량과 보행자의 잠재적 충돌 위험 상황을 자동으로 인식하는 방법론을 제시한다. 영상 내 도로 이용자의 위치 탐지의 자동화를 위해 객체 탐지 딥러닝 모델 중 하나인 mask R-CNN(Regional-Convolutional Neural Network) 모델을 활용하고자 한다. 또한, 비스듬히 획득된 CCTV 영상정보의 보정을 위하여, 접점(Contact point) 인식 및 시점 변환 등의 일부 전처리 과정을 거친다. 그 결과물로써, 도로 이용자의 정확한 위치 정보를 획득할 수 있으며, 이는 그다음 과정인 칼만 필터(Kalman filter) 기반의 객체 트래킹 방법론을 활용하여, 객체의 경로 및 행동 특징 정보(속도, 위치변화, 객체 간 거리 등)를 추출하여 분석에 활용된다. 본 연구에서 활용한 칼만 필터 기반의 객체 트래킹 방법은 기존에 객체의 트래킹에 활용되는 임곗값(Threshold)과 최소 거리 방법론(Minimum distance method)에 칼만 필터의 스무딩(Smoothing) 특성을 활용하여 객체의 트래킹에 활용하였다. 이에 대한 설명은 3-2절에서 상세히 기술한다.

도로교통안전 개선사업은 교통사고 자료 수집, 교통사고 위험장소 선정, 사고 발생 요인 및 문제점 분석, 개선계획 수립, 사업 시행 순으로 이루어진다. 효과적인 교통안전 사업 계획을 수립하기 위해서는 충분한 교통사고 자료가 필요하지만, 교통사고 데이터는 실제 교통 위험 상황에 비해서 턱없이 수가 부족하여 이를 의사결정에 활용하기 어렵다. 본 연구에서는 컴퓨터 비전 기반의 방법론을 통해 경기도 오산시의 9개 횡단보도에 설치된 CCTV 카메라에서 수집된 영상에 실 적용하여 차량과 보행자 간 잠재적 충돌 위험 상황을 파악하고, 파악된 위험 상황을 분석하여 횡단보도 내 차량과 보행자의 충돌 위험에 영향을 주는 요인들을 판정한 연구이다. 제안한 방법론을 이용하여 교통사고 위험이 빈번하게 발생하는 횡단보도와 교차로를 판정할 수 있고, 이를 통해 효과적으로 교통안전 개선사업에 대한 계획을 수립할 수 있다.

선행연구

차량과 보행자 간 상호작용에서 잠재적 충돌 위험 상황을 정량적으로 측정 및 인식하고 분석하기 위한 연구가 다양하게 이루어지고 있다. 특히, 잠재적 충돌 위험 상황을 측정하기 위하여, LiDAR(Light Detection and Ranging), RGB camera 등과 같은 다양한 센서를 활용하고 있다. 그 예로써, Wu et al.(2018)에서는 차량과 보행자가 서로의 궤적 교차 지점을 지나는 시간 차이(Post Encroachment Time, PET), 차량이 멈춘 지점과 그 시점에 차량과 보행자 사이의 거리(Distance between vehicle Stopped Position and Pedestrian, DSPP), 보행자와 차량 사이의 거리에 따른 차량의 속도 변화 추이를 이용하여 보행자의 잠재 위험 상황을 정의하였다. DSPP 계산 시 차량이 멈춘 시점은 차량 속도가 정확히 0이 되는 시점이 아닌 1mph보다 낮아지는 시점으로 정의하였다. Wu et al.(2020)에서는 차량과 보행자가 서로의 궤적 교차 지점을 지나는 시간 차이(PET), 차량의 위치에서 궤적 교차 지점까지의 거리와 차량의 허용 가능 정지거리 비율(Proportion of Stopping Distance, PSD), 그리고 차량 가속도가 허용 가능 가속도보다 높은 시점의 비율(Crash Potential Intex, CPI)을 이용하였다. 여기서 PSD는 차량의 해당 위치로부터 궤적의 교차 지점에 도달할 때까지 계속 감속하는 시점을 기준으로 하였고, CPI는 궤적의 교차 지점 도달 15초 전 모든 프레임에 대한 비율을 이용하였다. 그러나, 이와 같은 연구에서 주로 사용하는 센서인 LiDAR 센서는 설치 및 유지 시 높은 비용으로 인하여 광범위한 지역의 잠재 위험 상황 인식에는 사용할 수 없다는 한계점이 분명히 존재한다.

이러한 문제를 극복하기 위하여, 비교적 비용이 저렴한 카메라 센서를 기반으로 차량과 보행자 간 잠재적 충돌 위험 상황을 인식하는 연구도 국내·외적으로 활발히 진행되고 있다. Ke et al.(2017)는 차량에 부착된 카메라에서 수집된 영상을 기반으로 차량과 보행자의 잠재적 충돌 위험 상황을 인식하는 연구를 수행하였다. 차량과 보행자가 마주 보는 방향으로 이동 시 차량과 보행자가 같은 선상에 있게 되는 시간(Time To Collision, TTC) 그리고 그 시간 동안 보행자와 마주 보는 방향의 탑 뷰 관점에서 차량이 이동한 거리(Distance to Safety, DTS)로 잠재적 충돌 위험 상황을 판단하였다. Matsui et al.(2013)도 앞선 연구와 같이 TTC를 이용하여 잠재적 충돌 위험 상황을 정의하였으며, 보행자가 무단횡단을 하거나 장애물 뒤에서 갑자기 도로에 튀어나왔을 때 TTC가 짧은 것을 확인하였다. Noh et al.(2021)에서는 차량에 부착된 카메라가 아닌 CCTV 카메라를 이용하여 차량과 보행자의 잠재적 충돌 위험 상황을 인식하는 연구를 수행하였다. Noh et al.(2020)에서는 CCTV 카메라를 통해 얻은 차량과 보행자의 행동 정보를 k-평균 군집화 알고리즘을 활용하여, 잠재적 충돌 위험 상황을 그 특성별로 분류하고 각 클래스(군집)에 해당하는 행동 특징을 규칙화하여 위험도를 정성적으로 평가하였다. 그러나, 이들 연구에서 차량과 보행자의 잠재적 충돌 위험 상황을 정의하기 위해서 사용한 도로 이용자의 행동 정보가 제한적이기에 충돌 위험 상황을 포괄적으로 인식할 수 없었다는 한계가 존재한다.

이는 횡단 시 보행자의 행동 특징을 이해하고 분석에 활용함으로써, 횡단보도에서 차량-보행자 간 충돌을 감소시키는 방안 수립에 도움을 줄 수 있다. 그 예로써, Jiang et al.(2015)은 보행자가 횡단보도를 건널 때 보행자의 위치, 걷는 속도, 임계 차간간격1)(gap acceptance)에 영향을 미치는 요소에 관한 연구를 수행하였다. 이를 통해 성별, 나이, 횡단보도 내 보행자 수, 횡단보도 부근의 교통량이 횡단보도에서 보행자의 행동 특징에 영향을 미치는 것을 확인하였다. Onelcin and Alver(2017)는 신호등이 있는 횡단보도에서 보행자의 횡단 속도와 보행자 안전 간격(PSM)에 영향을 미치는 요소를 분산분석(Analysis of Variance, ANOVA) 방법론을 통해서 파악하였다. 이를 통해, 제한속도가 증가할수록 보행자 안전 간격이 감소하는 것을 확인할 수 있었다. Oxley et al.(2005)는 보행자의 나이대별 임계 차간 간격에 영향을 미치는 요소에 관한 연구를 수행하였고, 나이대와 무관하게 다음에 지나칠 차량과 보행자 사이의 거리가 임계 차간 간격에 영향을 주는 것을 확인하였다. 하지만 보행자의 특성만을 고려한 연구를 통해 차량과 보행자의 상호작용을 정확히 이해하는 것은 어렵다는 한계가 있다.

본 연구에서는 컴퓨터 비전 방법론을 이용하여 CCTV 영상에서 차량의 속력 및 횡단보도 접근 전의 정지 유무, 보행자 안전 간격(PSM)을 자동으로 추출하는 방법을 제시하며, 추출된 세 개의 지표를 모두 이용하여 차량과 보행자의 잠재적 충돌 위험 상황을 인식하는 방법론을 제안한다. 또한 차량과 보행자 간 잠재적 충돌 위험 상황을 비교 분석함으로써 잠재적 충돌 위험 상황에 영향을 주는 환경적인 요인을 확인한다. 다음 절에서는 연구에 사용한 데이터와 컴퓨터 비전 방법론을 이용하여 영상 데이터에서 도로 이용자의 행동 정보를 추출하는 방법을 서술한다. 실험 결과 절에서는 앞서 제시한 컴퓨터 비전 기반 방법론의 효과성을 검증하였고, 오산시의 CCTV 카메라 영상에 적용하여 차량과 보행자 간 잠재적 충돌 위험 상황을 인식하고 분석한 결과를 보여준다.

연구 방법

1. 데이터 설명

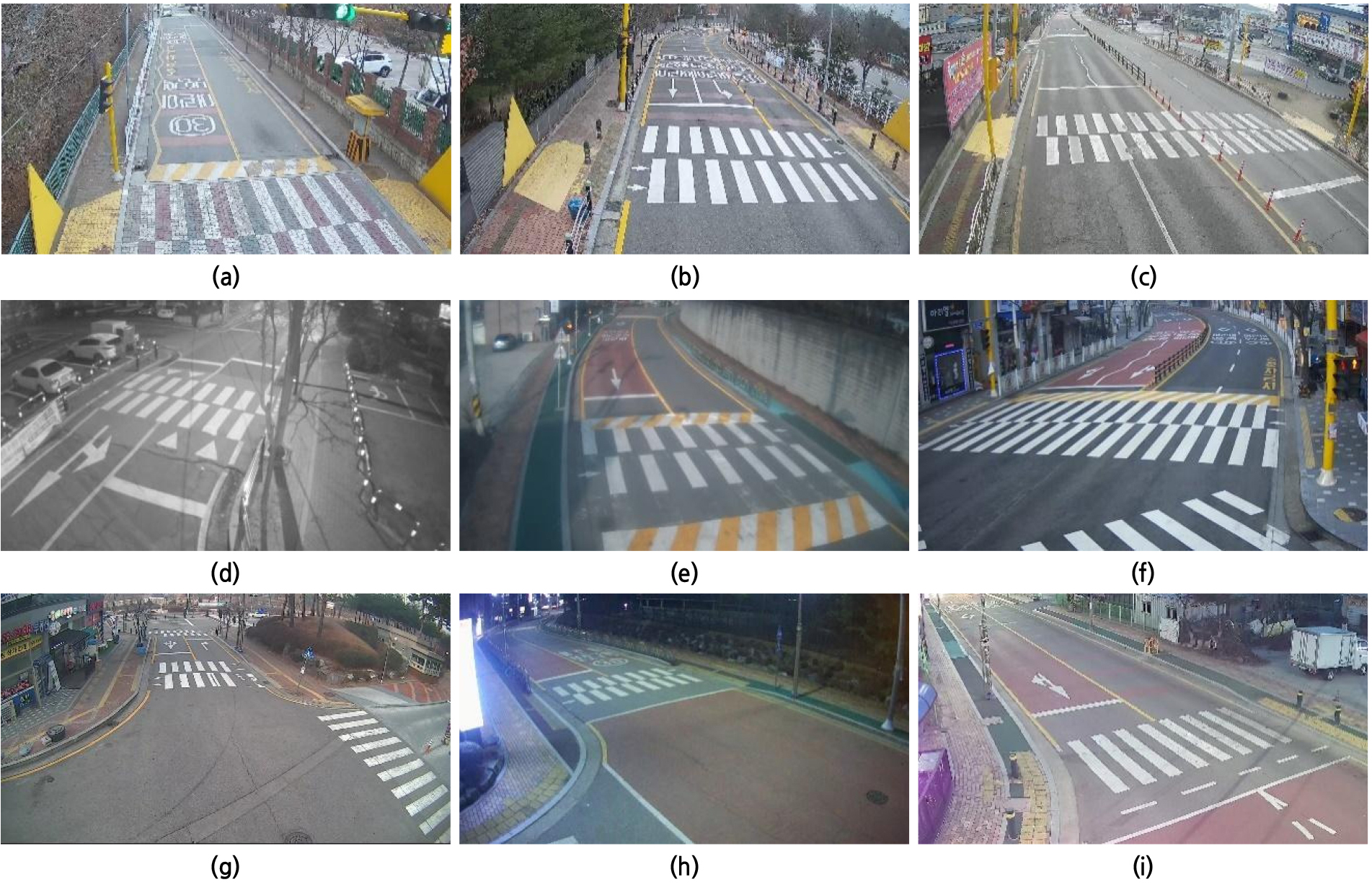

본 연구에서 활용된 영상 데이터는 경기도 오산시 내 횡단보도 9개소에 설치된 CCTV 카메라로부터 영상을 획득하였다. 본 연구에서 획득한 9개의 횡단보도는 각각 서로 다른 환경을 가지고 있으며, Table 1은 각 횡단보도의 특징을 상세히 설명한다. 또한, Figure 1은 CCTV에 녹화되는 횡단보도 영상에 대한 이미지 클립을 보여준다. 한편, 본 연구에서 활용한 CCTV 카메라는 본래 방범 등을 목적으로 하는 다목적용으로 설치되었으나, 보행자의 잠재적 위험 행동 분석을 위하여 활용하였다. 영상의 수집 기간은 2020년 1월 9일부터 1월 28일까지이며 매일 출퇴근 등으로 인해 유동 인구가 많은 오전 8시부터 10시, 오후 6시부터 8시의 영상을 활용하였다.

Table 1.

Characteristics of spot A - spot I

|

Site code | Camera name |

Crosswalk length (m) |

School zone |

Speed camera |

# of lanes |

Signal light |

Speed limit (km/h) |

Frame size |

Frame-per- sec (FPS) |

| A |

Unam Elemantary school, back gate #2 | about 8 m | + | x | 2 | + | 30km/h |

1920 1080 | 25 |

| B |

Yangsan Elementary school, main gate #1 | about 11 m | + | x | 3 | + | 30km/h |

1920 1080 | 25 |

| C |

Gohyeon Elementary school, back gate #2 | about 20 m | + | x | 4 | + | 30km/h |

1920 1080 | 25 |

| D |

Municipal Southern Welfater/Daycare center #3 | about 7 m | + | x | 2 | x | 30km/h |

1280 720 | 30 |

| E |

iFun daycare center #2 | about 8 m | + | x | 2 | x | 30km/h |

1280 720 | 30 |

| F |

Daeho Elementary school opposite side #3 | about 23 m | + | + | 4 | + | 30km/h |

1280 720 | 30 |

| G |

Segyo complex #9 back gate #2 | about 8 m | x | x | 2 | x | 30km/h |

1280 720 | 15 |

| H |

iNoritor daycare center #2 | about 8 m | + | x | 2 | x | 30km/h |

1280 720 | 11 |

| I |

Kids-mom daycare center #3 | about 7 m | + | x | 2 | x | 30km/h |

1920 1080 | 25 |

2. 컴퓨터 비전 기반의 차량-보행자 간 잠재적 충돌 위험 인식 방법

본 장에서는 컴퓨터 비전 기술을 기반으로 영상 내 차량 및 보행자 간 잠재적 충돌 위험을 인식하는 시스템과 그 절차 및 방법에 관하여 설명한다. 제안하는 시스템은 크게 영상 내 도로 이용자의 움직임 장면 추출, 객체 탐지 및 시점 변환, 차량 및 보행자의 경로 인식, 도로 이용자의 행동 특징 추출의 과정으로 구성된다. 먼저, 도로에 설치된 카메라 CCTV로부터 입력되는 영상 스트림으로부터 도로 이용자의 움직임이 있는 영상(이하 비디오 클립 또는 장면(scene))을 추출한다. 다음으로, 해당 비디오 클립 내에서 딥러닝 기반의 객체 탐지 모델을 활용하여 차량과 보행자를 탐지하고, 탐지된 객체들의 정확한 행동 특징 추출을 위하여 시점변환을 통해 탑 뷰(top-view)에서의 객체의 위치정보를 획득한다. 이와 같은 절차를 통해 차량과 보행자의 프레임별 각 객체의 경로 및 동일 객체에 대한 식별을 수행할 수 있으며, 이러한 경로를 바탕으로 객체의 속도, 위치 등과 같은 행동 특징을 추출한다. 또한, 이러한 행동 특징 정보뿐만 아니라, 보행자 안전 간격(Pedestrian Safety Margin, PSM) 등과 같은 잠재적 충돌 위험에 영향을 미치는 특징 정보들도 함께 추출할 수 있다.

1) 영상 내 도로 이용자의 움직임 장면 추출

본 절에서는 CCTV 영상으로부터 차량과 보행자의 움직임을 포함한 비디오 클립을 획득하는 방법에 관하여 설명한다. 일반적으로 도로에 설치된 CCTV 영상은 24시간 녹화되므로, 영상은 도로 이용자가 녹화되는 부분(Motioned video)과 어떠한 도로 이용자도 녹화되지 않는 부분(Idle state)으로 구성된다. 따라서, 효율적인 영상처리의 측면에서, 도로 이용자가 촬영되지 않는 idle 상태의 영상을 효과적으로 제거하고, 움직이는 장면을 포함하는 영상만을 추출할 필요가 있다. 이를 위해, 본 연구에서는 프레임 간의 픽셀 차이 정보를 계산하는 차 영상 기법(Frame difference method)을 사용하였다(Liu et al., 2016; Sengar and Mukhopadhyay, 2017).

제안하는 시스템에서 활용하는 차 영상 기법은 시점에서의 픽셀값과 시점에서의 픽셀값의 차이를 구한 후에 이를 임곗값과 비교하여, 임곗값을 넘는 시점을 영상 내 도로 이용자가 존재하고 있는 시점으로 정의하고, 해당 클립만을 추출한다(Equation 1). 이를 통해 간단한 행렬 연산으로 대량의 영상 데이터에서 빠르고 정확하게 도로 이용자가 이동하는 장면을 추출할 수 있다.

는 초일 때의 이미지 정보이며, 는 해당 이미지의 픽셀값을 의미한다. 차 영상 기법을 통해 전체 영상에서 약 45,890개의 비디오 클립을 획득하였다. 비디오 클립은 영상 내 도로 이용자 종류에 따라 차량 단독 장면(Car-only scene)과 차량-보행자 상호행동 장면(Interactive scene)으로 구분되며, CCTV마다 추출된 상황과 비디오 클립의 수는 Table 2에 나타난다.

Table 2.

The number of scenes and frames with moving road users

2) 객체 탐지 및 시점 변환

위에서 추출한 이동 장면에서 도로 이용자인 차량과 보행자의 행동 특징을 추출하기 위해서, 도로 이용자 객체의 탐지와 탑 뷰(Top view) 관점에서 도로 이용자의 위치를 인식이 선행되어야 한다. 따라서, 딥러닝 기반 모델을 활용하여 이미지 내에서 도로 이용자를 탐지하였으며, 탐지 시 ResNet-101-FPN 기반의 mask R-CNN 모델을 활용하였다. 본 연구에서는 Microsoft COCO(Common Object in Context) 이미지 데이터를 활용하여 사전학습을 수행하였으며, 중점적으로 살펴보는 도로 이용자(차량 및 보행자)를 준수하게 탐지하므로, 추가적인 학습은 수행하지 않았다. 본 실험에서는 Facebook AI Research(FAIR)에서 개발한 Detectron 2 플랫폼을 활용하여 mask R-CNN 모델의 학습 및 객체 탐지를 수행하였다. 객체 탐지를 위한 다양한 딥러닝 기반의 모델 중에서, 본 연구에서 활용한 mask R-CNN 모델은 각 객체의 바운딩 박스(Bounding box)와 객체에 해당하는 픽셀은 1, 배경 영역은 0의 값을 가지는 객체 마스크 행렬(Mask matrix)을 그 결과로 산출한다. 일반적인 객체 탐지 기반 접근 방법과 다르게, 본 연구에서는 이후 과정에서 활용되는 객체의 접점(Contact point) 인식 및 시점 변환을 수행하기에, 객체의 마스크 행렬값을 활용하고자 한다. 객체의 접점은 차량의 경우 차량 전면부, 보행자의 경우 머리 위의 좌표정보를 의미한다.

다음으로, 객체 좌표의 시점 변환을 수행한다. 일반적으로, CCTV 카메라로부터 획득되는 영상의 문제점 중 하나는 비스듬한 각도에서 장면들이 수집되고, 이에 대한 위치 정보가 추출된다는 것이다. 이처럼 비스듬한 각도에서 획득한 위치 정보는 도로 이용자의 정확한 위치 및 경로를 파악하기에 한계가 있으며, 행동 특징들 또한 정확하게 추출되지 않는다. 따라서, 비스듬한 각도(Oblique view)에서 획득된 영상정보를 탑 뷰 관점으로의 시점 변환이 필요하다. 이를 위해, 먼저, 객체 탐지 결과로 나타난 마스크 행렬과 차선 정보를 활용하여, 객체의 접점을 인식하고, 시점 변환을 위한 변환행렬을 활용하여 탑 뷰 관점으로의 시점 변환을 수행하였다. 그 결과로써, 비스듬한 각도에서 획득된 영상정보로부터 각 객체의 탑 뷰 관점에서의 위치 정보를 추출할 수 있다.

객체 탐지와 시점 변환의 일련의 과정은 영상 기반의 도로 특징 분석의 전처리 과정으로 활용된다. 본 과정에 대한 상세한 설명은 본 연구팀의 선행연구(Noh et al., 2020; Noh et al., 2018)에 상세히 기술되어 있다.

3) 차량 및 보행자의 경로 인식

다음으로, 각 비디오 클립으로부터 도로 이용자의 경로를 추적하기 위해서 칼만 필터 기반의 객체 트래킹 방법론을 활용하였다. 객체 탐지 결과는 각 객체의 접점 정보만을 포함하며, 연속된 이미지로 구성된 비디오 클립 내에서는 동일 객체에 대한 정보는 포함하고 있지 않기에, 객체 트래킹 과정이 필요하다. 칼만 필터는 컴퓨터 비전과 로보틱스 분야의 상태 추정(State estimation)에 많이 사용되며(Haroun et al., 2019), 영상에서 객체의 상태 추정 시에도 사용될 수 있다(Sun et al., 2010). 칼만 필터는 크게 두 가지 단계로 구성된다. 첫째는 상태 예측 단계이며, 그다음으로 예측 함수 갱신 과정을 수행한다. 즉, 상태 예측을 통해 얻은 상태 예측값과 실제 관측값을 이용하여 상태 예측 함수를 더 정확히 갱신하며, 이를 통해 미래의 상태를 더 잘 예측하는 과정을 반복한다. 우리가 도로 이용자 경로 추적에 사용한 변형된 칼만 필터에서는 객체의 위치와 속도를 평탄화(Smoothing)하여 다음 장면에서의 객체 위치를 예측하고, 다음 장면 객체들의 후보자 위치와 비교하여 가장 가까운 객체를 배정한다. 이 과정을 반복하여 도로 이용자의 경로를 추정한다.

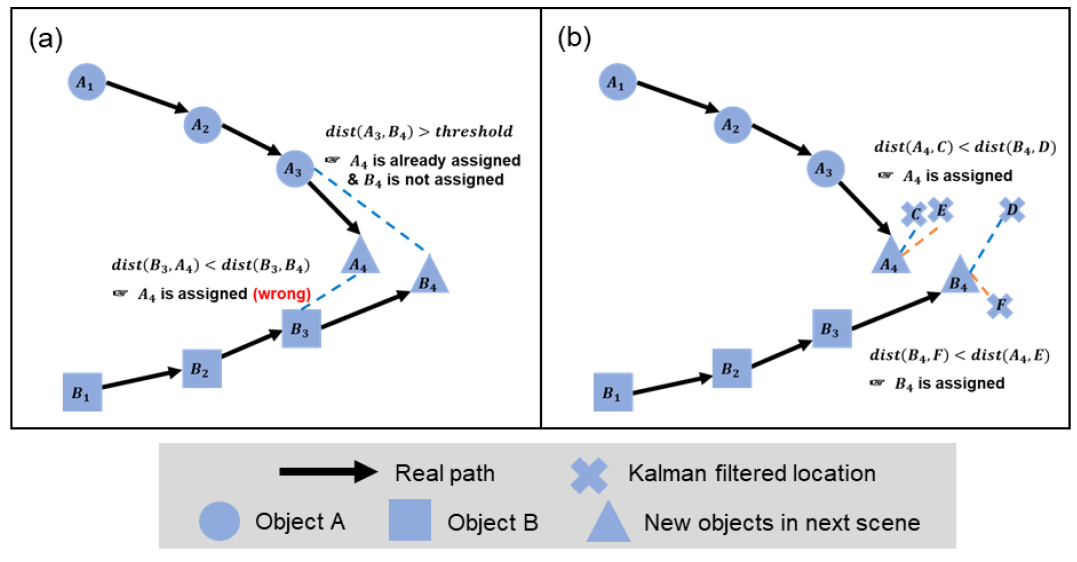

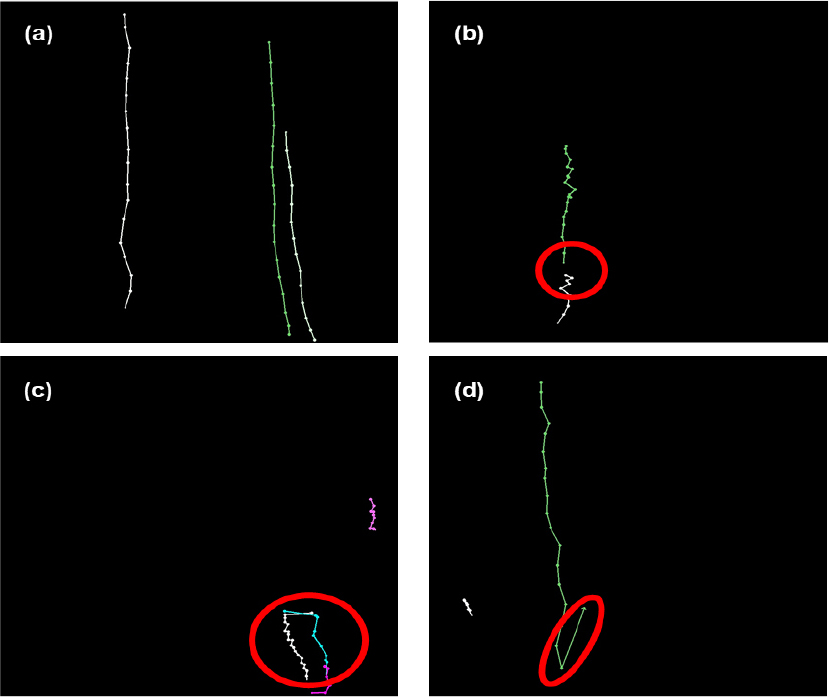

기존의 영상에서 도로 이용자 경로 추적 시 사용하는 알고리즘은 임곗값과 최소 거리 방법이다(Noh et al., 2020; Noh et al., 2018). 이 알고리즘은 계산 복잡도가 낮으면서 도로 이용자 위치 추적에 좋은 성능을 보이지만, 다음 장면의 객체를 경로에 배정하는 과정에서 가장 높은 확률의 객체가 아닌 가장 가까운 위치의 객체를 배정한다는 단점이 존재한다. 예를 들면, Figure 2(a)에서 위치 추정 정확도가 높은 객체 B에서부터 다음 장면의 객체를 배정할 때 객체 B의 마지막 위치 에서 다음 장면의 객체 중 가장 가까운 가 배정된다. 남은 는 객체 A의 경로에서의 마지막 위치 부터의 거리가 임곗값보다 크기에 배정이 되지 않는다. 결국 와 모두 잘못된 경로에 배정이 되는 현상을 확인할 수 있다.

우리가 제안한 변형된 칼만 필터는 다음 2가지 과정을 반복한다: (1) 다음 장면에 새로운 객체(원점 대상 객체)가 나타나면 Kalman 필터를 통해 새 객체를 포함한 각 궤적을 평활화함; (2) 평활화된 새로운 객체의 위치와 마지막 장면의 객체 위치의 거리 비교를 통해 가장 가까운 거리의 원점 대상 객체를 할당함. 예를 들면, Figure 2(b)는 변형된 칼만 필터 알고리즘을 통해 객체 와 의 궤적을 추적하는 과정을 보여준다. 객체 의 궤적(-)과 네 번째 프레임의 새로운 객체 의 위치를 평활화하여 얻은 위치를 , 또 다른 새로운 객체 의 위치와 평활화하여 얻은 위치를 라고 했을 때, 와 사이의 거리가 와 사이의 거리보다 짧기에 를 객체 의 궤적에 할당한다. 같은 과정을 통해 객체 의 궤적(-)에 를 할당한다. 이 과정을 통해서 Figure 2(a)의 임곗값과 최소 거리 방법처럼 잘못된 객체가 할당되는 현상을 막을 수 있다.

4) 도로 이용자의 행동 특징 추출

횡단보도 내의 차량과 보행자의 잠재적 충돌 위험을 인식하기 위해 크게 3가지의 행동 특징을 추출하였다. 첫 번째는 차량의 속도이다. 차량의 속도가 높으면 보행자가 차량과의 충돌을 피하기가 어려우며 추돌 사고의 심각도와 일부 연관이 있다. 차량의 속도는 연속된 장면에서의 차량의 위치 변화를 연속된 장면 사이의 시간으로 나누어 계산한다. 여기서 연속된 장면의 위치 변화는 픽셀 단위로 계산되기 때문에 이를 미터(m) 단위로 변환해야 한다. 횡단보도의 영상에서의 픽셀 단위 거리와 실제 미터 단위 거리의 비율()을 이용하여 이를 변환하였다. 연속된 장면 사이의 시간()은 분석에 사용하기 위해 추출하는 장면 사이의 간격을 영상의 시간당 수집하는 장면 수(Frame-per-second, FPS)로 나누어 계산한다. 이를 통해 얻은 번째 객체의 번째 장면에서의 m/s 단위 차량 속력(Equation 2)을 km/h로 변환하여 분석에 사용하였다.

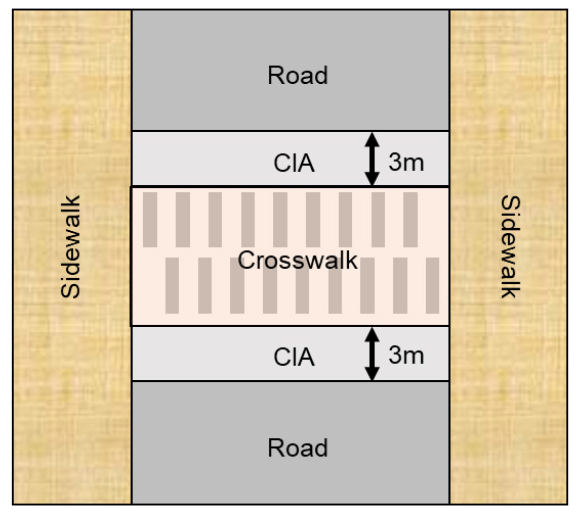

두 번째로 사용한 행동 특징은 차량이 횡단보도에 접근하기 전 정지 유무이다. 차량은 횡단보도를 지나치기 전 정지 후에 횡단보도를 지나는 것이 가장 이상적인 상황이다. 이를 잘 준수하는지 확인하기 위해서 횡단보도와 횡단보도 영향 지역(Crosswalk Influenced Area, CIA) 접근 10m 전 차량의 정지 여부를 확인한다. 횡단보도 영향 지역을 포함한 이유로써, 보행자는 도로 횡단 시 정확한 횡단보도 영역뿐만 아니라, 횡단보도 영역 양옆의 영역으로도 일부 횡단하는 것으로 나타났기에, 횡단보도 영향 지역 부분을 포함하였다. 또한, 본 연구에서 활용된 영상 분석 결과, 일부 보행자는 횡단보도의 양옆 약 3m까지도 도로 횡단에 활용하고 있기에, 이번 연구에서는 횡단보도의 양옆 3m까지를 횡단보도 영향 지역으로 설정하였다(Figure 3). 또한, 대부분의 차는 전방에 보행자가 확인되는 경우 정확히 횡단보도 앞 정지선에서 정지하는 것이 아닌, 그 이전부터 감속해오거나, 정지하는 경향이 존재한다. 따라서, 횡단보도 접근 10m 전 차량의 정지 여부를 확인하고자 한다. 이러한 수치는 차량과 보행자의 행동 특징 및 도로의 환경적 특징(고속도로 라면 더 멀리서부터 감속을 확인해야 함)에 따라 다양하게 설정될 수 있다.

한편, 영상을 기반으로 하는 정보이기에, 센서의 인지능력, 객체 탐지 알고리즘의 성능 등 다양한 요인에 의하여 객체 행동 정보가 정확하게 추출되기는 어려운 환경이다. 따라서, 차량 속도 측정 시에도 오차가 존재하기에 차량의 속력이 정확히 0이 되는 시점이 아닌, 속력 허용 오차(9km/h)보다 속력이 작아지는 시점으로 차량의 정지 시점을 정하였다. 차량의 속력 허용 오차 설정에 대한 기준은 3-1절의 실험 결과 부분에서 설명한다.

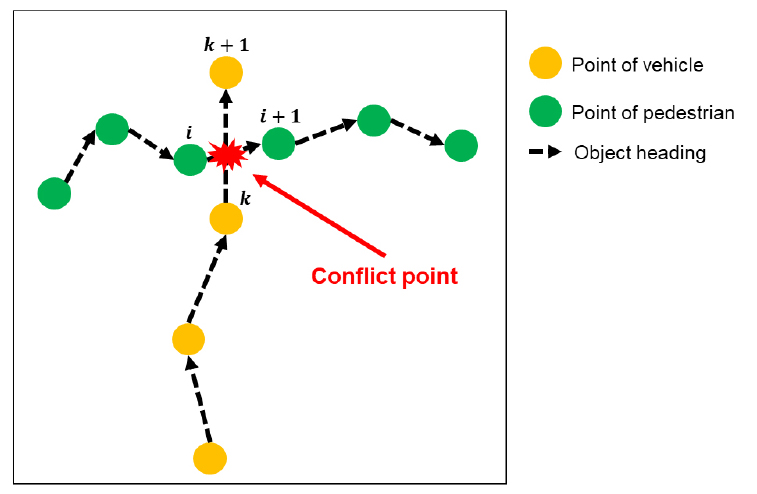

마지막으로 활용된 행동 특징 정보는 보행자 안전 간격(PSM)이다. 보행자 안전 간격은 다양한 방식으로 정의돼왔으며(Avinash et al., 2019; Oxley et al., 2005; Lobjois and Cavallo, 2007), 본 연구에서는 보행자 안전 간격을 Figure 4에서 나타나 있는 보행자와 차량 경로의 충돌 지점을 지나는 차량과 보행차의 시간 차이를 이용하여 정의한다. 충돌 지점을 지나는 보행자의 시간을 , 차량의 시간을 라고 할 때, 이 시간 차이 를 보행자 안전 간격으로 정의하였으며, 그 수식은 Equation 3과 같다.

여기에서 는 충돌 지점을 지나기 직전 보행자의 장면 번호이고, 는 충돌 지점을 지나기 직전 차량의 장면 번호이다. 는 연속된 장면 사이의 시간이다. 여기에서 충돌 지점의 경우 중간값 정리(Intermediate Value Theorem, IVT) 알고리즘을 이용하여 계산된다. 보행자 안전 간격 값이 음수일 경우 차량이 보행자보다 먼저 지나쳤다는 뜻이고, 이는 양의 값인 상황에 비해 상대적으로 위험한 상황이다. 또한, 이 값의 부호와 상관없이, 0에 가까울수록 차량과 보행자의 충돌 위험이 큰 상황이라고 볼 수 있다.

분석 결과

1. 도로 이용자의 행동 특징 추출 정확도 평가

1) 도로 이용자의 위치 추정 정확도 평가

연구 방법의 2-2절에서의 탑 뷰 관점에서의 도로 이용자를 탐지하는 알고리즘이 효과적인지 확인하기 위해서 mask R-CNN 모델과 변환행렬을 통해서 추정한 위치가 실제 위치와 가까운지를 평가하였다. 평가는 위치 허용 오차가 10cm, 20cm, 35cm, 50cm, 70cm일 때 횡단보도별로 차량과 보행자의 위치 추정 정확도를 계산하는 방식으로 진행하였다. 위치 추정 정확도는 12명의 실험자가 뽑은 수직 사진에서의 차량과 보행자의 위치 기준점과 알고리즘을 통해 추정한 위치를 비교하여 둘 사이의 거리가 위치 허용 오차 이내인 경우를 세어서 계산하였다. 각 실험자는 횡단보도마다 100개의 수직으로 변환된 장면에 대해서 도로 이용자의 위치를 뽑았으며, 이를 이용하여 계산한 정확도는 Table 3에 요약되어 있다.

위치 허용 오차가 50cm 이상일 때 차량과 보행자의 위치 추정 평균 정확도는 약 0.89 이상으로 나타난다. 위치 허용 오차가 50cm일 때 가장 낮은 위치 추정 정확도를 보이는 횡단보도는 B 지역이었으며, 차량의 위치 추정 정확도가 약 0.88이고, 보행자의 위치 추정 정확도가 0.87로써 강건한 위치 추정을 보여줬다. 이를 통해서 본 연구에서 제시한 mask R-CNN 모델과 변환행렬을 이용한 방법이 도로 이용자의 위치 기준점을 추정하는 데에 효과적이었음을 보여준다.

일반적으로 속도는 위치와 시간에 따라 결정되므로, 위치 허용 오차에 따라 속도 허용 오차가 발생할 수 있다. 따라서, 본 연구에서 활용한 시간 기준(FPS)과 약 50cm의 위치 오차를 허용한 경우, 약 9km/h의 속도 허용 오차가 발생하기에, 이러한 오차 정보를 반영하여, 속도가 9km/h인 경우는 거의 정지해있는 것으로 간주하고 분석을 수행하고자 한다.

Table 3.

Accuracy of the proposed vehicle and pedestrian detection in overhead view with varying distance tolerance

| Site code | Distance tolerance (cm) | |||||||||||

| Target object | ||||||||||||

| 10 | 20 | 35 | 50 | 60 | 70 | |||||||

| V | P | V | P | V | P | V | P | V | P | V | P | |

| A | 0.18 | 0.10 | 0.36 | 0.23 | 0.69 | 0.51 | 0.93 | 0.89 | 0.95 | 0.90 | 0.95 | 0.91 |

| B | 0.17 | 0.09 | 0.31 | 0.23 | 0.70 | 0.48 | 0.88 | 0.87 | 0.97 | 0.88 | 0.98 | 0.97 |

| C | 0.10 | 0.10 | 0.24 | 0.19 | 0.64 | 0.52 | 0.90 | 0.90 | 0.95 | 0.87 | 0.96 | 0.88 |

| D | 0.25 | 0.11 | 0.32 | 0.14 | 0.72 | 0.53 | 0.90 | 0.90 | 0.95 | 0.91 | 0.97 | 0.91 |

| E | 0.17 | 0.14 | 0.28 | 0.11 | 0.71 | 0.49 | 0.89 | 0.87 | 0.96 | 0.95 | 0.97 | 0.95 |

| F | 0.12 | 0.12 | 0.29 | 0.17 | 0.69 | 0.56 | 0.90 | 0.93 | 0.94 | 0.90 | 0.96 | 0.94 |

| G | 0.17 | 0.12 | 0.37 | 0.21 | 0.72 | 0.51 | 0.89 | 0.91 | 0.90 | 0.94 | 0.92 | 0.93 |

| H | 0.14 | 0.13 | 0.25 | 0.20 | 0.70 | 0.46 | 0.90 | 0.91 | 0.92 | 0.92 | 0.93 | 0.92 |

| I | 0.11 | 0.10 | 0.23 | 0.17 | 0.68 | 0.45 | 0.89 | 0.84 | 0.94 | 0.92 | 0.96 | 0.94 |

| Average | 0.16 | 0.11 | 0.30 | 0.18 | 0.69 | 0.50 | 0.90 | 0.89 | 0.94 | 0.91 | 0.95 | 0.93 |

2) 객체 추적 알고리즘 평가

본 절에서는 연구 방법의 2-3절의 연속된 장면에서 칼만 필터 기반 객체 트래킹 방법론을 활용하여 각 객체의 경로를 획득하는 방법에 대한 효과를 검증하고자 한다. 이를 위하여, 기존의 객체 트래킹 방식 중 하나인 임곗값과 최소 거리 방법과 그 성능을 비교하였다. 성능 비교를 위하여 connectivity, crossing, directivity의 세 가지 기준을 제시한다. 먼저, connectivity는 연속된 장면에서 객체가 끊어짐 없이 추적되었는지를 확인하는 지표이며, crossing은 두 개 이상의 객체가 서로의 경로를 침범하지 않고 이동하였는지 확인하는 지표로 활용된다. 마지막으로, directivity는 다음 장면에서의 다른 객체가 해당 객체의 경로에 배정이 되는 경우를 판단하는 지표이다.

Table 4와 Table 5는 각각 임곗값과 최소 거리 알고리즘과 칼만 필터 기반의 객체 트래킹 방법론을 활용하여 횡단보도별로 connectivity, crossing, directivity에 따른 추적 오류의 수와 객체 추적 정확도를 요약한 표이다. 정확도는 횡단보도별로 추적된 객체의 경로가 앞서 정의한 3가지 기준을 위반하는지 확인하여 산출된다. Figure 5는 수작업으로 판별한 객체가 알고리즘을 통해 잘 추적된 사진과 3가지 기준을 각각 위반한 예시를 나타낸다.

변형된 칼만 필터를 사용한 것이 사용하지 않은 방법론에 비해서 객체 추적 정확도가 평균적으로 3% 정도 향상한 것을 확인하였다. 또한, 변형된 칼만 필터를 통해 추적한 객체의 경로 중에서 앞서 정의한 3가지 기준을 위반한 객체 경로의 수가 3가지 기준 모두에서 감소했으며, 평균적으로 connectivity 관련, crossing 관련, directivity 관련 오류가 각각 7%, 37%, 24% 감소한 것을 확인하였다.

Table 4.

Accuracy of object tracking by the threshold and minimum distance algorithm considering connectivity, crossing and directivity error (car threshold=100 and pedestrian threshold=50)

Table 5.

Accuracy of object tracking by the modified Kalman filter algorithm considering connectivity, crossing and directivity error (car threshold=100 and pedestrian threshold=50)

2. 보행자 잠재 위험 상황 평가

1) 차량 속력과 보행자 안전 간격 기반 평가

Table 6은 카메라가 설치된 횡단보도별 차량 속력의 기술 통계를 보여준다. 횡단보도별로 최대 속력은 약 51.3km/h에서 87.5km/h 사이로, 최소 속력은 약 2.2km/h에서 9.4km/h 사이로 분포한다. 횡단보도별 평균 속력은 약 14.0km/h에서 36.5km/h 사이에서 분포하며 모든 횡단보도의 제한속도가 30km/h인 것으로 보아 추정된 차량 속력이 합리적임을 알 수 있다. 또한, 차량만 있는 상황과 차량과 보행자가 모두 있는 상황(Interactive scene)을 비교했을 때, 모든 지역에서 차량만 있는 상황에서 평균 차량 속력이 높은 것을 확인할 수 있었다. 이를 통해 보행자가 있을 때 차량의 속력이 낮은 경향을 보이는 것을 확인할 수 있었다.

횡단보도별로 평균 차량 속력을 비교했을 때 C 지역에서 가장 높은 것을 알 수 있다. 이는 대부분의 차선 수가 2개이거나 3개인 지역에 비해 높게 나타났다고 할 수 있으나, I 지역(차선 수=2)과 비교하였을 때, 단순히 차선 수에 비례하지는 않는다는 것을 알 수 있다. 따라서, 본 분석에서는 단순히 차선 수와 차량 속도의 비교가 아닌 주변의 전반적인 환경적 요인을 함께 비교하고자 한다. 그 비교 대상으로써, 차선 수, 제한속도, 신호등 유무, 스쿨존 여부 등의 환경적 요인을 비슷하게 갖는 F 지역과 비교해볼 수 있다. 그러나, F 지역은 과속 카메라가 설치되어 있기에, F 지역의 차량 평균 속력은 20.9km/h로 C 지역보다 약 15km/h 이상 낮게 나타났다. 이를 통해, 과속 카메라가 설치함으로써 차량 과속을 일부 억제할 수 있음을 알 수 있다.

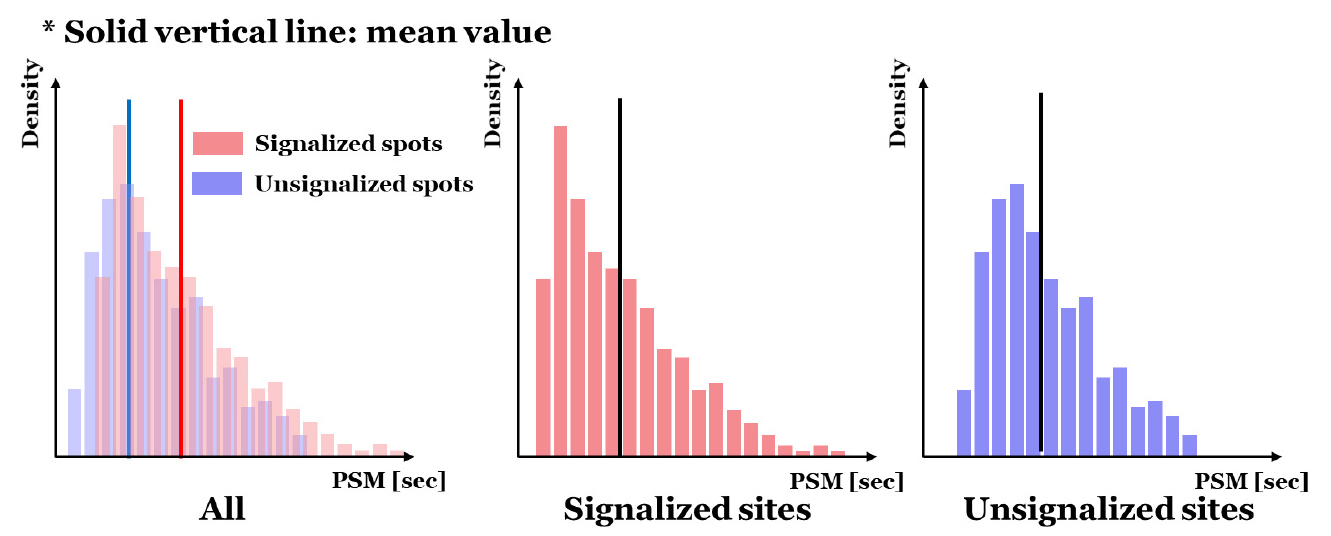

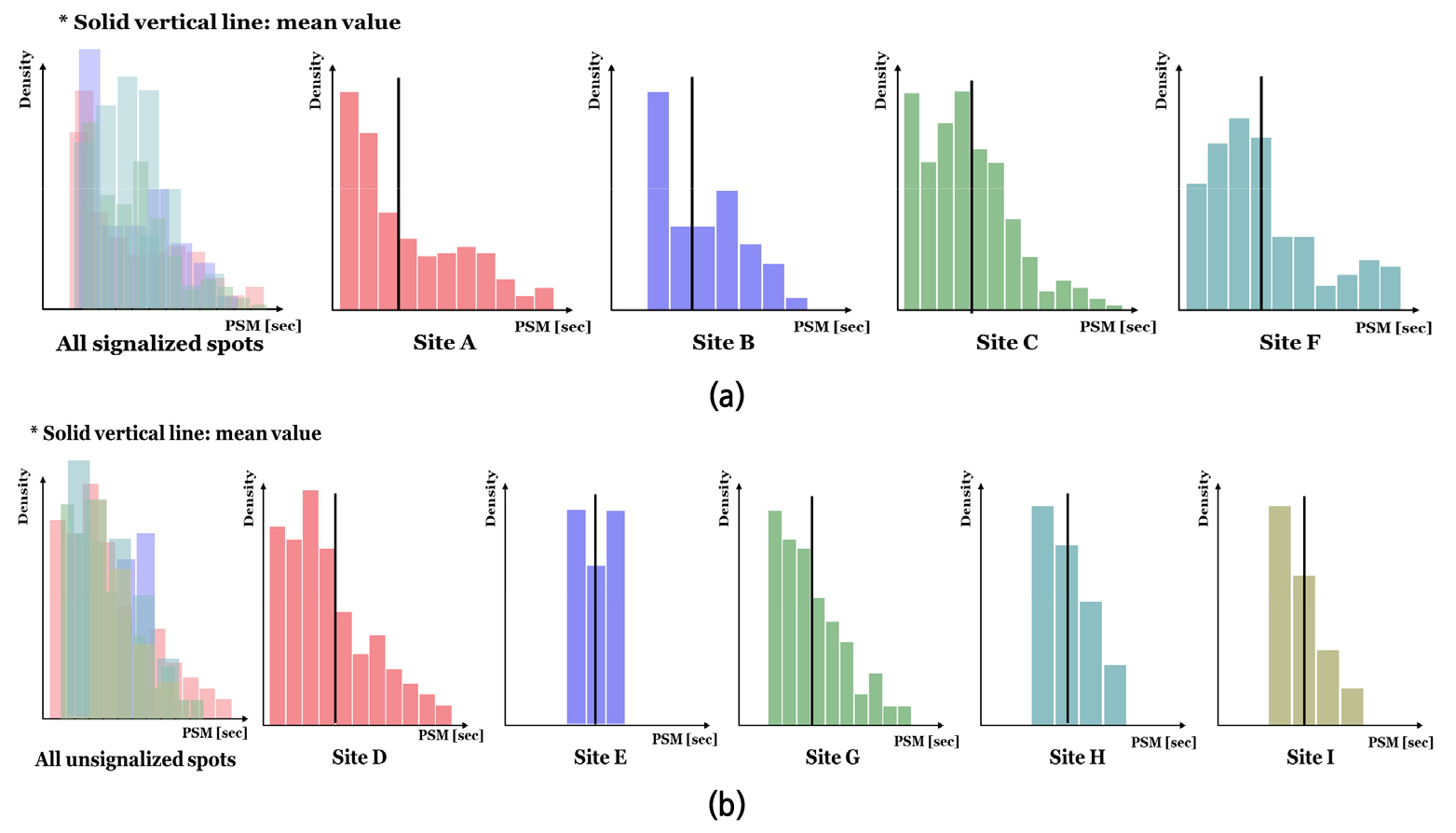

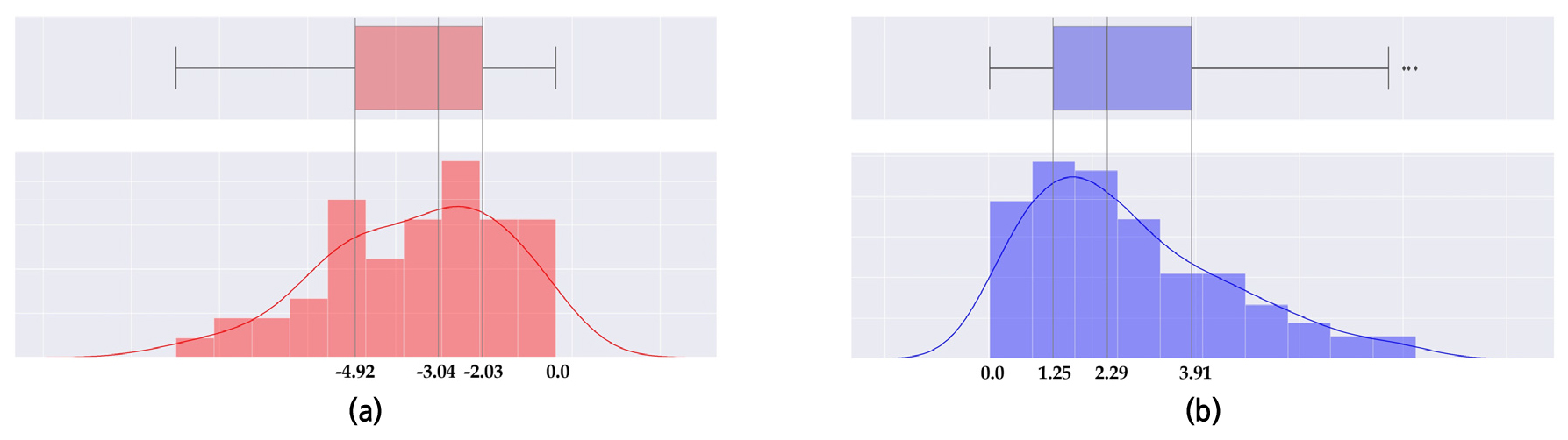

보행자 안전 간격의 분포를 통해서도 횡단보도별 차량과 보행자의 충돌 위험을 비교할 수 있다. 안전 간격의 경우, 그 값이 음의 값을 가진다면, 차량이 보행자보다 먼저 횡단보도를 지나는 것을 의미하고, 양의 값을 가지는 경우, 보행자가 먼저 횡단보도를 지나는 것을 의미한다. 본 절에서는 보행자가 먼저 지나가고 몇 초 후에 차량이 해당 영역을 지나가는지를 기준으로 보행자의 잠재 위험에 대한 평가를 수행하고자 한다. 따라서, Figures 6과 7에서 보행자 안전 간격의 분포를 나타낼 때, 보행자 안전 간격이 음인 장면은 제외했다. Figure 6에서 신호등이 있는 횡단보도는 신호등이 없는 횡단보도에 비해서 보행자 안전 간격이 전반적으로 높게 분포하는 것을 볼 수 있다. 이를 통해 신호등이 있는 횡단보도에서 보행자가 상대적으로 더 안전한 경향이 있는 것을 확인할 수 있다.

Table 6.

Descriptive statistics of vehicle speed on spot A to spot I

Figure 7에서는 횡단보도별로 나누어 보행자 안전 간격을 비교하였다. 신호등이 있는 횡단보도 중에서는 A 지역과 B 지역에서의 보행자 안전 간격의 분포가 C 지역과 F 지역에서보다 상대적으로 왼쪽으로 치우쳐져 있는 것을 확인할 수 있다. 이는 A 지역(차선 수=2)과 B 지역(차선 수=3)에서의 차선 수가 C 지역과 F 지역의 4차로에 비해서 좁아서 보행자의 초록색 신호가 짧기 때문으로 보인다. 신호등이 없는 횡단보도에서는 G 지역을 제외하고는 비슷한 보행자 안전 간격 분포를 보였다. 이는 G 지역은 높은 유동 인구를 보이는 지역이며, 횡단보도를 포함한 도로의 양 끝이 교차로여서 차량이 조심히 운전하기 때문에 보행자 간격이 전반적으로 높다고 추정할 수 있다. 이는 Table 6에서 G 지역에서의 차량의 평균 속력이 14km/h로 모든 횡단보도 중 가장 낮은 것으로도 확인할 수 있다.

2) 횡단보도 부근에서의 차량 정지 행동 기반 평가

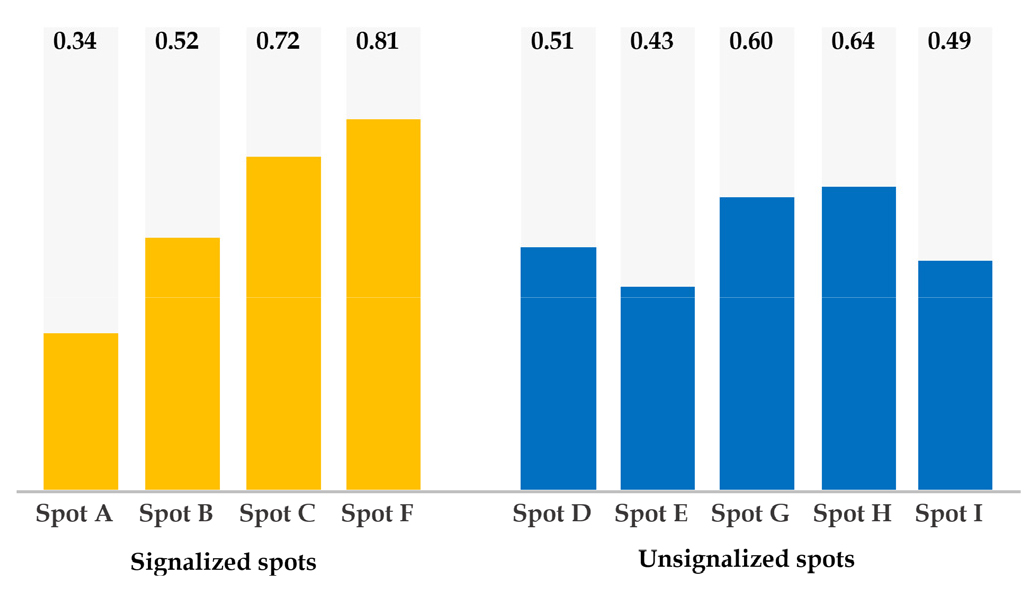

보행자가 있을 때 차량은 횡단보도를 지나기 전 정지를 한 후에 다시 이동하는 것이 중요하다. 이번 절에서는 보행자가 횡단보도를 건널 때 차량이 정지하는지를 횡단보도별로 비교 분석하였다. 이 결과는 Figure 8에서 확인할 수 있다.

신호등이 있는 횡단보도 중에서는 A 지역에서 차량이 정지하는 비율이 가장 낮게 나타났다. 이는 다른 횡단보도의 차선 수가 3개 이상이지만 A 지역은 차선 수가 2개인 것을 통해 설명할 수 있다. F 지역에서는 정지하는 비율이 0.81로 모든 횡단보도 중에서 가장 높게 나타났다. 이는 F 지역에만 설치되어 있는 과속 단속 카메라가 신호를 더 잘 지키도록 유도한 것으로 보인다. 여기에서 보행자가 횡단보도를 건널 때 차량이 정지하지 않았다는 것은 결국 신호를 위반했다는 것으로 볼 수 있기에 차량 정지 비율을 신호를 지킨 비율로 해석하였다. 신호등이 없는 횡단보도 중에서는 G 지역과 H 지역에서 높은 정지 비율을 보이는 것을 확인하였다. 이는 H 지역에서 도로 위에 어린이보호구역이라는 표식을 새겨 운전자에게 경각심을 준 것이 하나의 요인이 될 수 있다. G 지역의 경우 앞선 절에서 설명한 것과 이 지역의 높은 유동 인구와 양 끝점의 교차로 때문에 운전자가 더 조심함을 알 수 있다.

3) 보행자 안전 간격 및 차량 정지 행동 기반 평가

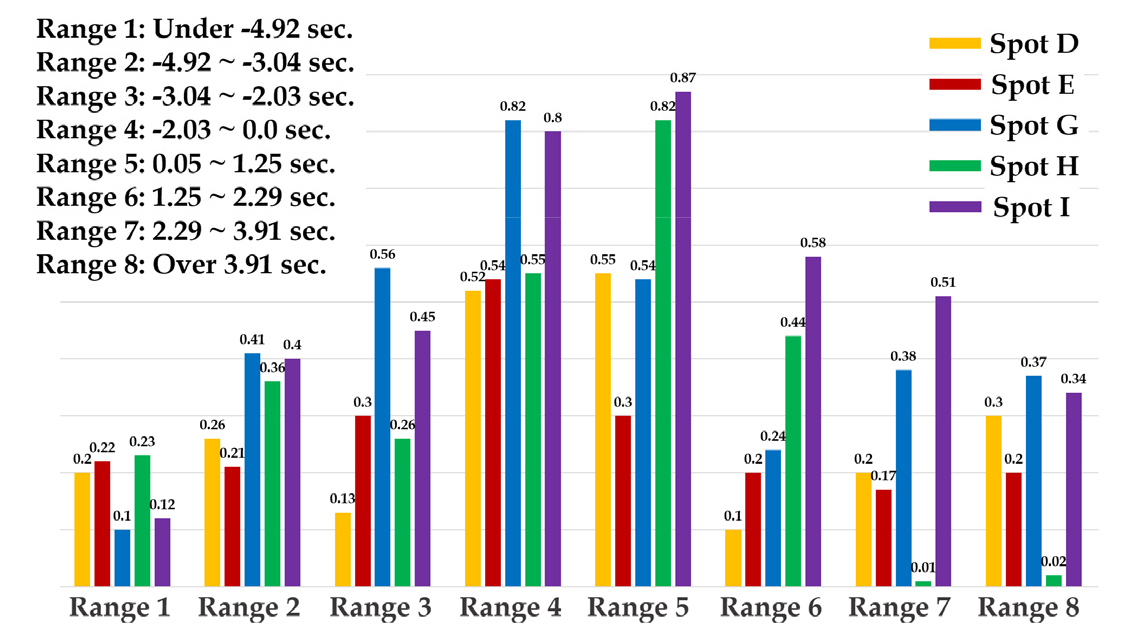

보행자 안전 간격은 앞서 설명한 것처럼 0에 가까울수록 잠재적 충돌 위험성이 크다는 의미가 있다. 차량은 보행자 안전 간격이 0에 가까울수록 횡단보도를 지나치기 전 정지해야 하며, 보행자 안전 간격의 절댓값이 크더라도 횡단보도 부근에서 무단횡단을 하는 보행자가 있을 수 있기에 정지 후에 지나가는 것이 안전하다. 3-2절의 1)의 분석관점과는 다르게, 이번 절에서는 보행자 안전 간격에 따라서 운전자의 정지 행동의 변화를 확인하는 것에 그 목적이 있기에, 안전 간격의 부호와 관계없이, 0에 얼마나 더 가까운 값을 가지는지 살펴보고자 한다. Figure 9는 신호등이 없는 횡단보도에서 보행자 안전 간격별 차량 정지 비율을 횡단보도별로 나타낸 그림이다. 여기서 신호등이 없는 횡단보도만 비교한 이유는 신호등이 있는 횡단보도는 차량 정지 여부가 보행자 안전 간격보다는 신호등에 의해서 결정되기 때문이다.

본 분석에서는 주어진 보행자 안전 간격을 범주화(Categorization)하여, 구간을 나누어, 보행자 안전 간격의 구간별 차량 정지 비율에 대해 살펴보고자 한다. 보행자 안전 간격의 구간을 나눈 기준은 보행자 안전 간격이 양일 때와 음일 때 각각 사분위 수를 구하여 계산했다. 모든 상황의 보행자 안전 간격 분포에서 사분위 수를 구하면 상황의 수가 많은 I 지역의 보행자 안전 간격의 사분위 수에 치우쳐 계산될 수 있기에 각 횡단보도의 분포에 Equation 4의 가중치를 곱하여 최종 보행자 안전 간격의 분포를 계산하였다. 여기에서 는 신호등이 없는 횡단보도에서의 상황(비디오 클립)의 수를 합한 값이고, 는 해당 횡단보도에서 나타난 차량-보행자 간 상황의 수이다.

그 결과는 Figure 9와 같이 나타나며, 범주화 결과를 살펴보면, (1) −4.92 이하; (2) −4.92 - −3.04; (3) −3.04 - −2.03; (4) −2.03 - 0; (5) 0 - 1.25; (6) 1.25 - 2.29; (7) 2.29 - 3.91; and (8) 3.91 이상의 8개의 범주로 나타났으며, 각각 range(구간) 1-8로 표시된다. 0.0-0.05 사이의 값은 잠재적 충돌이 아닌 실제 사고가 발생한 영역으로 볼 수 있기에, 해당 영역의 값은 존재하지 않는다.

그 결과를 살펴보면, Figure 10과 같이, 차량 정지 비율은 보행자 안전 간격이 0에 가까울수록 높은 것을 확인할 수 있었다. 그러나, E 지역에서는 보행자 안전 간격이 구간 5(0.05초-1.25초)에 속할 때 차량 정지 비율이 0.3으로 낮은 것을 확인할 수 있었다. 이를 통해 E 지역에서 단속 카메라 설치 등의 보행자 안전 강화를 위한 조치가 필요할 것으로 보인다. 보행자 안전 간격이 큰 구간 2, 3, 7, 8에서는 차량 정지 비율이 D, E, H 지역에서 낮게 나왔다. 이는 G 지역 및 I 지역과 다르게 보행자 안전 펜스가 있어 보행자가 횡단보도 부근 외에서 도로를 건너는 상황이 발생할 가능성이 작기에 운전자가 덜 조심하는 것으로 보인다. 즉 보행자 안전 펜스가 오히려 운전자의 경각심을 줄여서 차량과 보행자의 충돌 위험을 증가시킬 가능성이 있다는 것을 확인했다.

결론

본 연구는 컴퓨터 비전 방법론을 이용해 CCTV 카메라 영상에서 차량과 보행자의 잠재적 충돌 위험을 인식하는 방법론을 제시하였다. 이 과정에서 우리는 mask R-CNN과 OpenCV의 시점변환행렬을 이용하여 비스듬한 영상에서 탑 뷰 시점에서 도로 이용자의 위치를 찾는 것과 칼만 필터 기반의 객체 트래킹 방법론을 이용하여 도로 이용자의 경로를 추적하는 방법론을 제안하였다. 추출된 도로 이용자의 궤적을 기반으로 차량의 속력, 차량의 정지 행동, 보행자 안전 간격을 추정하였으며 이를 기반으로 차량과 보행자의 잠재적 충돌 위험을 인식하였다. 또한, 잠재적 충돌 위험을 횡단보도별로 비교 분석함으로써 어떤 환경적인 요소가 잠재적 충돌 위험에 영향을 미치는지 확인하였다.

제시한 방법론을 오산시에 위치하는 9개의 횡단보도 부근의 CCTV 카메라에서 수집한 영상 데이터에 적용하여 효과성을 검증하였다. Mask R-CNN과 OpenCV의 변환행렬을 이용하여 추정한 탑 뷰 시점에서의 도로 이용자의 위치는 위치 허용 오차가 50cm일 때 차량에 대해서 0.90, 보행자에 대해서 0.89의 정확도를 보였다. 변형된 칼만 필터를 이용한 객체 추적 방법론은 임곗값과 최소거리 방법에 비해 평균적으로 정확도가 0.03이 증가하였으며, connectivity, crossing, directivity에 관한 평균 오류가 모두 감소한 것으로 보아 변형된 칼만 필터를 통한 객체 추적이 효과적이었음을 알 수 있다. 추적된 도로 이용자의 궤적을 통해 차량의 속력, 보행자 안전 간격, 횡단보도에 보행자가 있을 때 차량의 정지 행동, 보행자 안전 간격에 대한 차량의 정지 행동 변화와 같은 도로 이용자의 행동 특징을 추출할 수 있었다.

본 연구에서는 경기도 오산시 내 9개의 횡단보도에서 추출한 도로 이용자의 행동 특징을 기반으로 차량과 보행자의 잠재적 충돌 위험 상황을 다각적으로 분석하였다. 그 분석 결과를 요약하자면, 차선 수가 많고 과속 단속 카메라가 존재하지 않는 경우 차량의 속력은 경향을 보였으며, 신호등이 없는 횡단보도에서 보행자 안전 간격이 0에 가깝게 분포하는 것을 확인할 수 있었다. 신호등이 없는 횡단보도 중 일부에서는 스쿨존임에도 불구하고 대부분 횡단보도에서 대략 50%의 차량이 정지 행동을 보이지 않았으며, 이 경우에 단속 카메라 설치 등의 보행자 안전 강화 조치가 필요할 것으로 사료된다. 또한, 신호등이 없는 횡단보도에서 보행자 안전 간격에 대한 차량의 정지 행동을 분석한 결과 보행자 안전 간격이 높을 때 보행자 안전 펜스가 없는 지역에서 오히려 차량의 정지 비율이 낮은 경향을 확인하였다. 그러나, 본 연구에서 분석 대상으로 활용한 횡단보도는 9개이기에, 본 자료만을 토대로 모든 횡단보도에서의 행동 특징만으로 잠재적 충돌 위험의 패턴을 도출하고, 일반화하는 것은 무리가 있다. 따라서, 본 연구에서 제안하는 방법론을 활용하여 잠재적 충돌 위험 정보를 일반화하고, 더욱 세밀하고 의미 있는 정보를 얻기 위해서는 더욱 많은 수의 횡단보도의 정보를 활용하여 분석이 수행되어야 할 것으로 사료된다.