서론

기존 연구의 고찰

1. 자율주행 차량 인지 범위의 한계 및 협력주행 인프라 시스템

2. 딥러닝 기반의 객체 검출 기술

3. 객체 추적 기술

4. 엣지 기반의 영상 분석

차량 인식 및 추적 알고리즘

1. 차량 객체 검출을 위한 신경망 구조 설계

2. 차량 추적 알고리즘

실험 및 검증

1. 실험 환경

2. 객체검출 알고리즘

3. 차량 추적 알고리즘

결론 및 향후 연구과제

서론

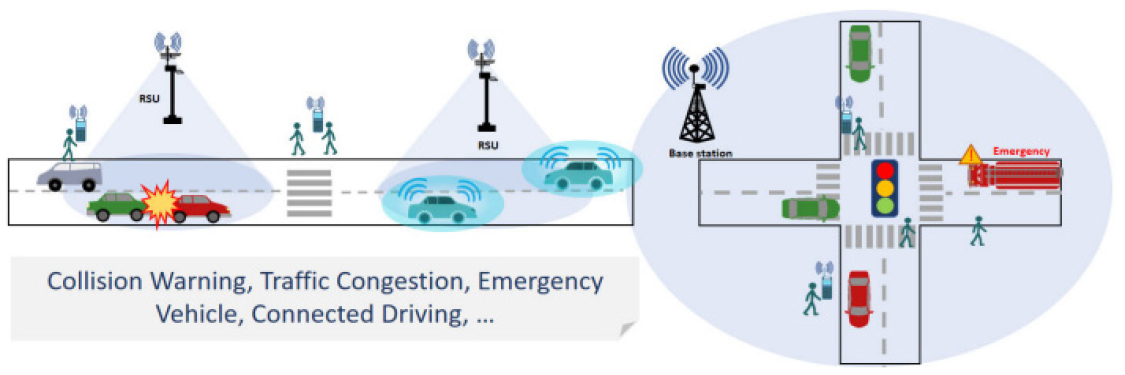

자율주행 기술의 고도화 및 상용화에 따라 차량 자체 센서의 인지 범위의 확장을 위한 인프라 기반 협력주행기술에 대한 수요가 증가하고 있다. 기존의 자율주행 차량들은 장착된 센서들을 활용하여 주변의 환경을 인지하고 주행 경로를 계획하는 독립 인지, 독립 주행을 기본으로 동작한다. 하지만 이러한 구성의 자율주행 방식은 차량의 센서에서 인지하지 못하는 환경에 대한 위험성이 여전히 남아있다. 이러한 문제를 해결하기 위하여 노변에 설치되어 교통 상황을 실시간으로 파악하고 기록하여 차량에 제공할 수 있는 Figure 1 형태의 엣지 인프라 기술 연구(Yoon, 2020; Mun, 2022)가 활발하게 진행되고 있으며, 정보 수집을 위한 센서에 대한 연구도 활발한 상황이다(Hwang, 2019).

특히, 최근 CNN 기반의 영상분석을 통한 교통정보 수집 기술에 대한 연구도 활발히 진행되고 있는데 이러한 CNN 기반의 알고리즘(Park et al., 2019)은 영상 내의 외양 특징을 기반으로 개별 객체를 식별할 수 있어 자율주행 자동차에서 인식하지 못하는 도로상의 객체 정보를 제공할 수 있어 인프라 구축에 활용이 가능할 것으로 주목받고 있다. 기존 C-ITS의 구축에서도 이미 영상 분석기술들이 차량의 교통량을 산출하는 VDS(Vehicle Detection System), 돌발상황 감지 시스템 등의 형태로 적용된 사례가 있다. 하지만 기존 C-ITS 시스템의 경우 대부분 딥러닝 알고리즘의 높은 연산량으로 인하여 영상에 대한 분석을 현장이 아닌 센터에서 처리하고 있거나 좌회전 감응 등의 제한적인 분석만을 수행하고 있다(Eun, 2011). 하지만 이러한 방식을 그대로 협력주행 인프라로 활용하기에는 정보 제공 지연에 따른 사고 발생 위험이 남아있다(Choi, 2021). 이에 본 연구에서는 지연시간으로 인해 발생하는 정보의 딜레이를 최소화하기 위해, 센터가 아닌 노변에 위치하여 실시간으로 영상을 분석, 도로에 존재하는 객체들을 인지하여 LDM에 제공할 수 있는 차량 검지 시스템을 개발하고자 한다.

기존 연구의 고찰

1. 자율주행 차량 인지 범위의 한계 및 협력주행 인프라 시스템

최근 활발하게 연구되고 있는 자율주행 자동차의 기술은 적응형 크루즈 컨트롤이나 차선 유지 보조 기능의 2단계를 넘어 제한적 자율주행이 가능한 3단계 기술들이 상용화되어있다. 하지만 일반 도로환경에서 독립적인 자율주행이 가능한 4단계나, 모든 도로 상황에서 완전한 자율주행이 가능한 5단계에 이르기에는 여전히 극복해야 할 문제들이 남아있다. 현재 테슬라, 현대 자동차 등의 완성 차량 제조 업체를 중심으로 자율주행 시스템이 보급되고 있다. 하지만 다양한 객체와 장애물이 존재하는 도심 환경에서는 전방 차량으로 인한 시야 차단이나 시야 바깥에서 갑작스럽게 진입하는 사람이나 차량, 오토바이 등의 객체, 신호기 고장으로 인한 수신호 운영 상황 등 자율주행 차량의 단독 인지 및 판단으로는 안전한 주행을 보장할 수 없는 상황이 다수 존재한다(Roh, 2020). 또한, 자율주행 차량의 센서 미인식으로 인한 사고 또한 발생할 수 있는데(Jin, 2022), 이러한 문제들은 현재 개발된 자율주행 차량들의 독립 센싱의 한계에서 비롯된다. 현재의 자율주행 차량들은 자신의 옆 차선 및 전후방에 대한 부분인지만을 수행하고 있으며, 차량의 단독 판단에 있어 타 차량의 판단 및 경로 계획을 고려하지 않고 있는 상황이다

이러한 자율주행 차량의 센싱 및 경로 판단에 대한 한계를 극복하기 위해 LDM(Local Dynamic Map) 기반의 협력 드라이빙에 대한 연구가 활발하게 진행되고 있다. 실제 최근 연구에서 확인할 수 있듯이 고속도로의 합류부나 분류부 등 특수한 환경에서는 자율주행 차량으로 인한 도로의 과포화가 발생할 가능성도 존재한다(Kim, 2021). 이에 최근 국내의 한 연구에서는 회전 교차로나 무신호 교차로 등 자율주행 차량의 부분 인지로 인한 한계로 안전하고 원활한 운행이 힘든 구간에서 도로 노변에 설치된 인프라 센서들을 활용하여 차량의 인지 범위를 확장할 수 있는 도로 노변 인프라에 대한 개념이 정립된 바가 있다. 특히 도로 노변에 설치된 인프라 센서들에서 수집된 다양한 객체의 동적 정보를 LDM에 업데이트하고, 해당 정보를 기반으로 목표 범위 내의 차량에 대한 인프라 가이던스를 제공함으로써 자율주행 차량의 안전성을 증대시키려는 연구가 진행된 바 있다(Mun, 2022).

2. 딥러닝 기반의 객체 검출 기술

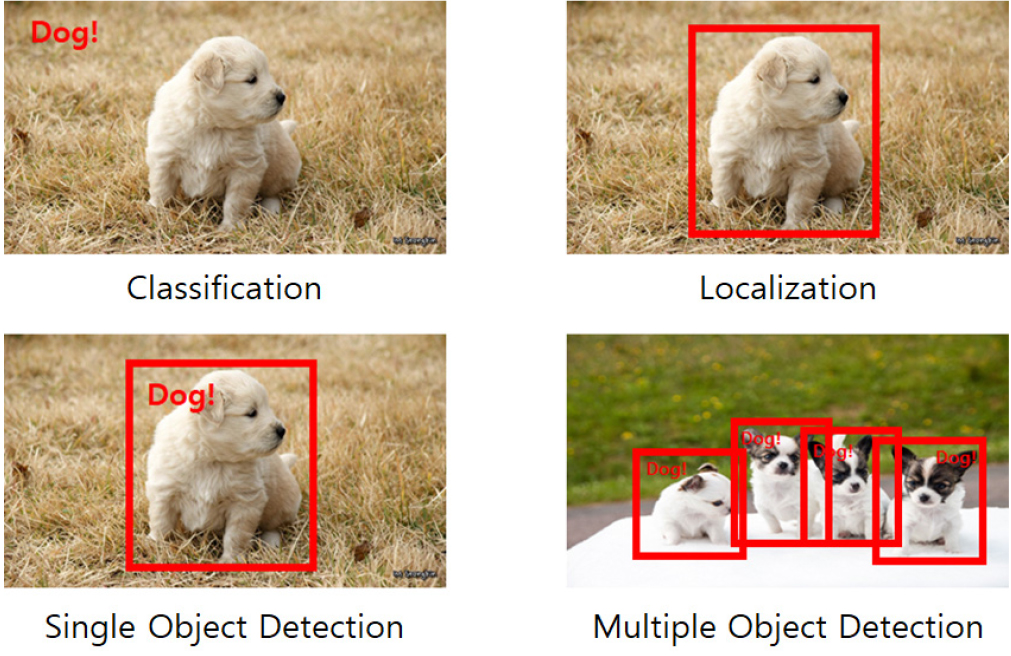

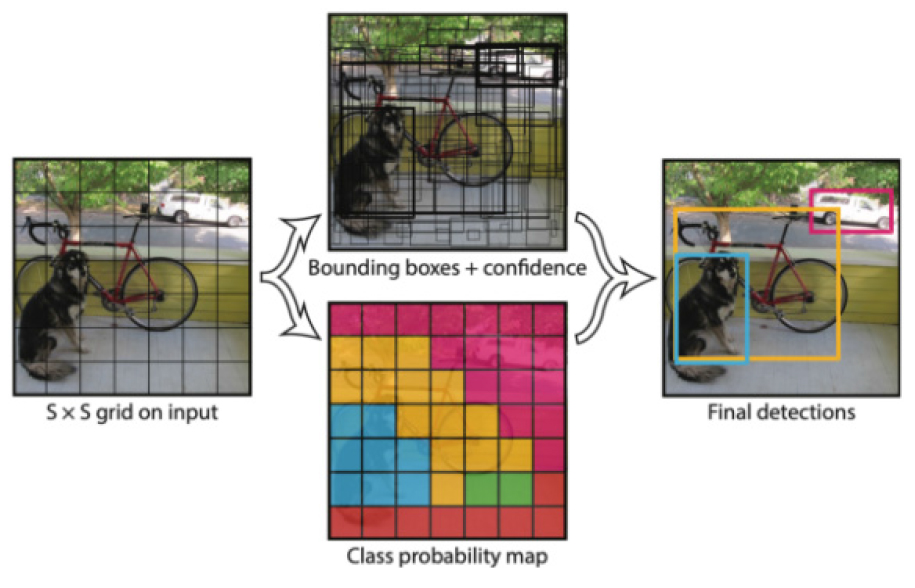

객체 검출(Object detection) 기술은 입력 영상에서 존재하는 검출 대상 물체에 대해 지역화(Localization)와 분류(Classification)를 수행하는 작업이다. Figure 2에 나타난 바와 같이 분류 작업은 입력 영역의 종류를 결정하는 작업이며, 지역화는 객체의 위치를 찾아 경계 상자(Bounding Box)를 특정하는 회귀(Regression) 작업이다. 객체검출 기술은 분류 작업과 지역화 작업이 병합된 기술로써, 단일 객체검출 기술과 다중 객체검출 기술로 분류할 수 있다.

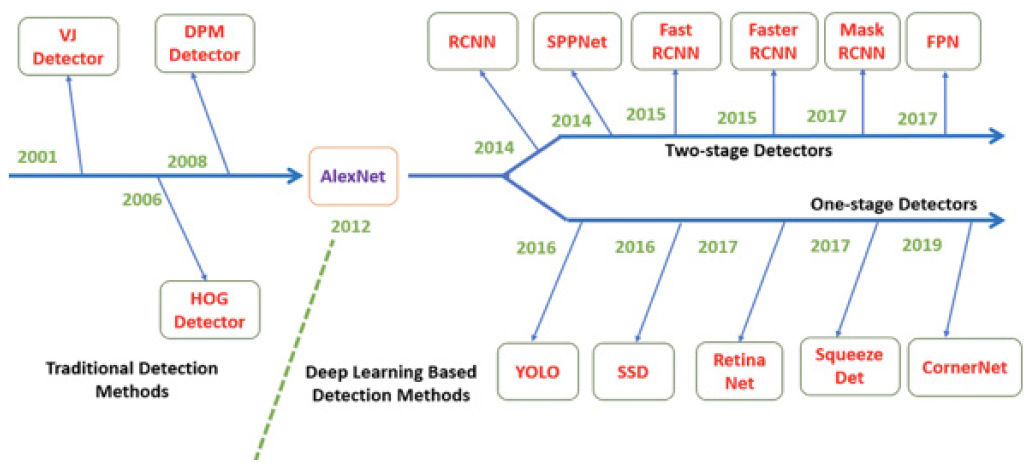

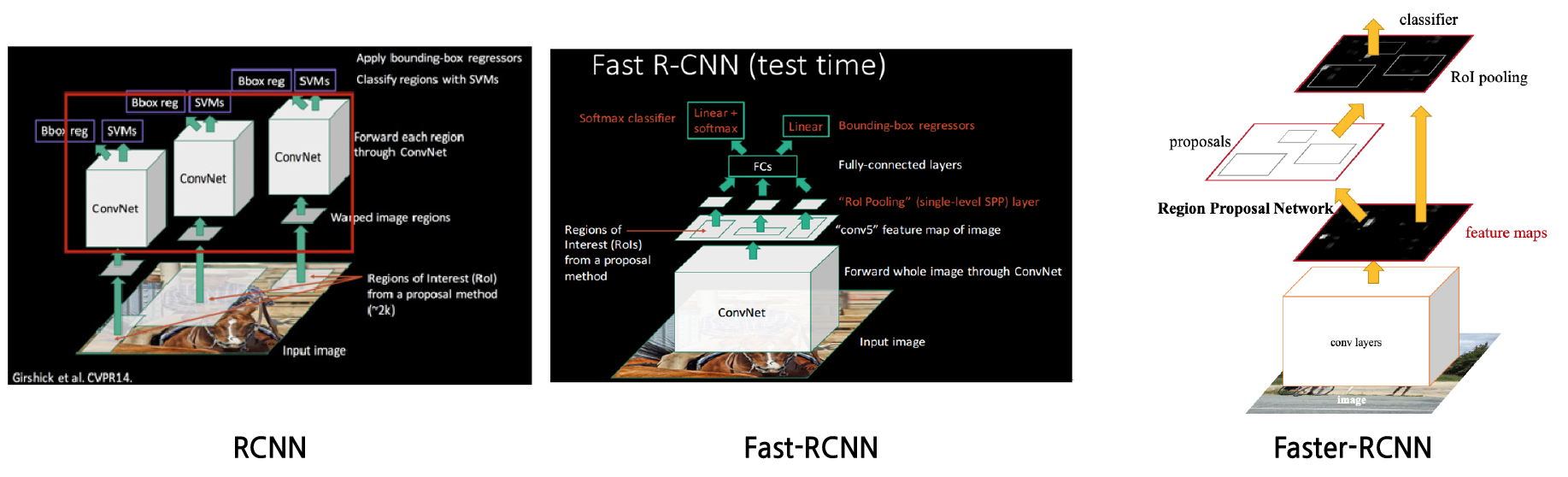

최근 활발하게 연구되는 CNN을 이용한 딥러닝 기반의 객체 검출 기술들은 주로 다중 객체 검출 알고리즘이며, Figure 3에 나타난 것 같이 지역화의 문제와 분류의 문제를 동시에 진행하는 1-Stage 검출기와 두 문제를 순차적으로 진행하는 2-Stage 검출기로 구분할 수 있다. 대표적인 2-Stage 검출기는 R-CNN, Fast R-CNN, Faster RCNN 등이 있으며, 1-Stage 검출기로는 YOLO, SSD 등의 알고리즘이 존재한다.

2-stage 검출기는 객체의 지역화와 분류 작업을 2단계에 나누어 순차적으로 진행하는 알고리즘으로써, 상기 과정을 한꺼번에 수행하는 1-stage 검출기 대비 검출 성능이 높다. 대표적인 알고리즘으로는 R-CNN 계열의 신경망이 있는데, 해당 알고리즘들의 경우 지역화를 위한 Region Proposals 단계와 해당 영역의 Classification 단계가 나누어져 있어 상대적으로 연산량이 많다는 단점이 있다. Figure 4는 대표적인 2-stage 검출기의 예시다.

대표적인 1-stage 알고리즘인 YOLO는 네트워크 최종 출력 단계에서 지역화와 분류 작업이 동시에 이루어진다. 하나의 네트워크를 이용하여 특징을 추출하고 지역화, 분류 작업을 수행하기 때문에 2-stage 검출기에 비하여 상대적으로 빠른 속도를 보인다. 하지만 Figure 5에서 확인할 수 있듯이 그리드 셀 기준으로 객체를 검출하기 때문에 사전 정의된 anchor box에서 크게 벗어나는 객체를 찾을 수 없다는 단점이 있다. 하지만 도로에 설치되는 교통 인프라의 경우, 화면상의 객체가 대체로 균일한 형태와 크기를 가지고 있어 해당 알고리즘을 적용하기에 적합할 것으로 판단된다.

3. 객체 추적 기술

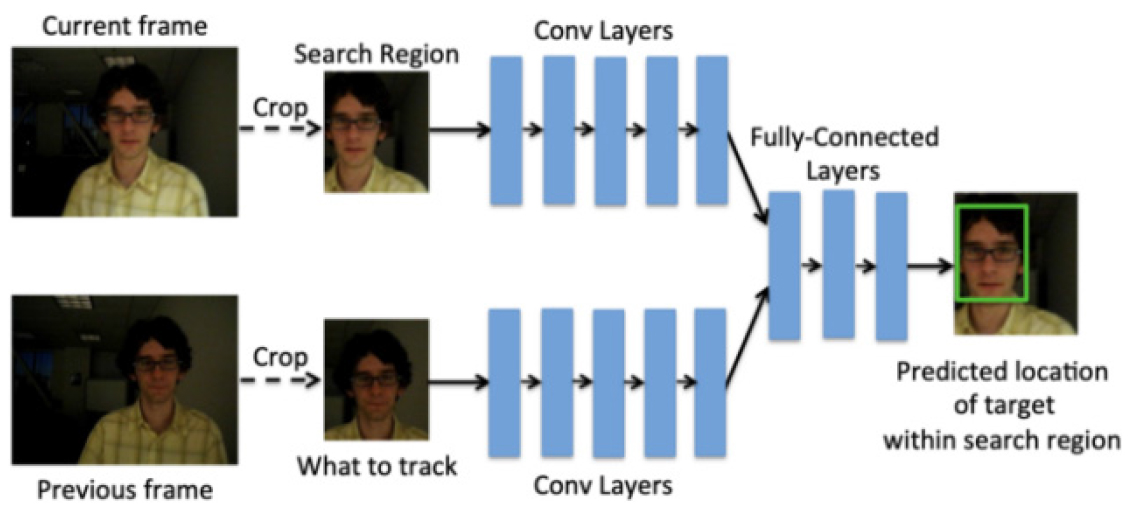

객체 추적(Object Tracking) 기술은 여러 프레임 사이에서 관측되는 각각의 객체에 대한 연속성을 판단하는 작업으로 크게 VOT(Visual Object Tracking)와 MOT(Multiple Object Tracking) 기술로 구분할 수 있다. VOT는 주로 단일 객체의 추적에 활용되는 방식으로 첫 번째 프레임 내부의 객체 위치정보를 바탕으로 연속된 프레임에서 해당 객체의 위치를 추적해나가는 기술이다. 과거에는 템플릿 매칭(Template Matching) 기술들이 주로 활용되었으나 최근에는 CNN 알고리즘을 활용한 GOTURN 등의 딥러닝 기반의 알고리즘들이 개발되었다. Figure 6은 대표적인 VOT 알고리즘인 GOTURN의 구조를 나타낸 그림으로 객체의 좌표를 특정하는 Full-Connected Layer를 포함하고 있다(Held, 2016).

다중 객체의 추적을 위한 MOT 알고리즘은 각 프레임에서 추적 대상을 탐색하는 객체검출 단계와 각 프레임 사이의 검출 결과를 연관시키는 추적 단계로 이루어져 있다. 추적단계에서는 객체의 검출 단계에서 False Negative나 False Positive에 대한 보정이 이루어지는데, 현재의 프레임과 직전의 프레임을 이용하는 Online 추적과 전체 비디오를 입력받아 모든 프레임을 사용하는 Offline 추적 방법으로 구분할 수 있다. Offline 추적은 높은 정밀도가 요구되는 저장된 비디오에 대한 분석에 주로 활용되고 있으며, 도로 영상을 분석하기 위한 객체 추적 알고리즘으로는 Online 추적 방식이 주로 활용되고 있다(DGT, 2014).

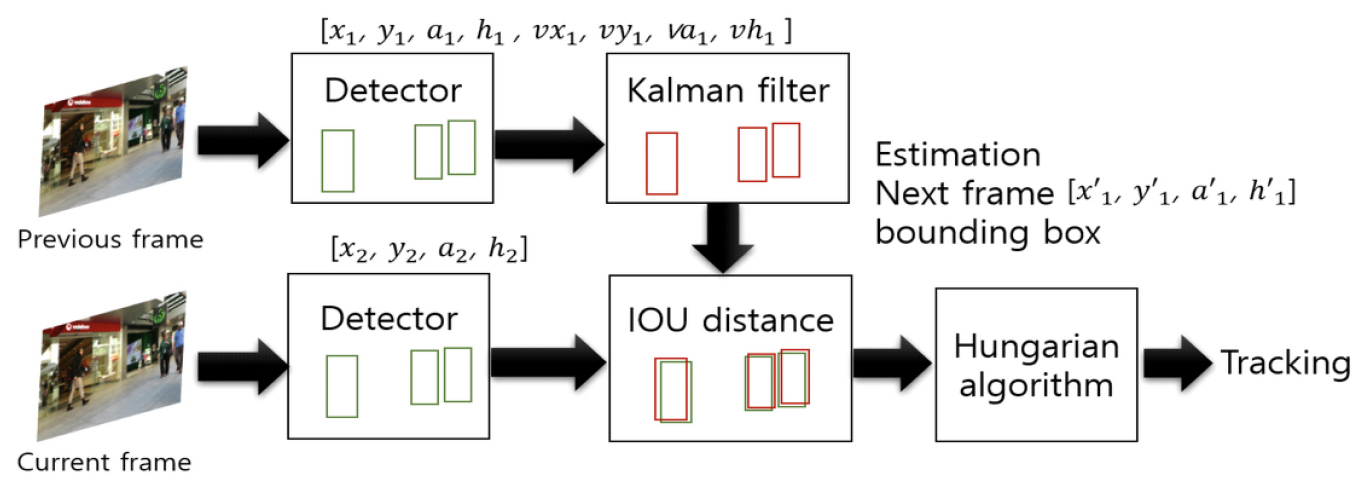

대표적인 Online 방식의 다중 객체 추적 알고리즘으로는 SORT(Simple Online and Realtime Tracking)이 있으며, 해당 알고리즘은 객체검출 알고리즘과 칼만 필터를 기반으로 구성된다. 자세한 구조는 Figure 7과 같으며, 해당 알고리즘은 칼만 필터를 이용하여 검출 과정에서 발생하는 오류의 영향을 감소시킬 수 있으며, 칼만 필터를 통해 예측된 이동 정보와 검출기에서 주어지는 경계 상자(Bounding Box)의 연관(Assignment) 문제를 해결하는 방식으로 이루어져 있다. 연관 문제를 해결하기 위하여 SORT 알고리즘은 IOU Distance 기반의 헝가리안 매칭 알고리즘을 활용하고 있다.

하지만 해당 알고리즘의 경우, 검출된 객체의 위치만을 바탕으로 연관 작업을 수행한다는 한계가 있는데, Deep SORT 알고리즘은 객체의 생김새 기반의 거리를 새롭게 제안하였다(Wojke, 2017). CNN 기반의 딥러닝 알고리즘은 연관 작업에서 IOU 기반의 Distance Metric을 대체하며, 탐지된 객체의 경계상자를 추출하여 각각의 특징맵을 형성한다. 하지만 해당 알고리즘은 객체의 수가 늘어남에 비례하여 특징의 생성에 필요한 연산량이 증가하므로, 객체가 많은 도로환경에 적용하기에는 어려움이 있다.

4. 엣지 기반의 영상 분석

최근 수행된 C-ITS의 정의에 관한 연구에서는 C-ITS에서 요구하는 최소한의 지연시간을 300ms로 정의하고 있다(Maaloul, 2021). YOLOv5 등의 신경망을 이용하여 객체를 인식하고 모니터링 할 수 있는 방안에 대한 연구가 수행된 바 있으나, 해당 알고리즘의 경우 높은 연산량을 요구할 뿐만 아니라, 카메라와 분석 서버와의 거리에 따른 네트워크 지연으로 300ms의 지연시간을 보장할 수 없다는 한계를 가지고 있다. 이러한 흐름에 따라, 기존의 높은 하드웨어를 기반으로한 센터 중심의 데이터 분석을 현장으로 가져오려는 시도들이 이루어지고 있다. 특히 보행자 충돌방지나 협력주행 인프라 구축 등 초저지연 정보 분석이 필요한 분야에서 도로에 위치한 카메라에서 영상을 분석하는 엣지 형태의 카메라에 대한 연구가 진행된 바 있으나, 해당 연구의 경우 객체의 검출 정보만을 제공할 뿐, 다른 객체와의 충돌확률을 예측하는데 필요한 객체의 이동 궤적 정보등을 포함하지 않고 있다(Park et al., 2019).

객체의 추적 정보를 포함하는 연구들도 존재하였다. YOLO와 SORT 알고리즘을 활용한 차량의 추적 정보 산출에 대한 연구(Yoon, 2020)도 존재하였으나, SORT 알고리즘(Bewley, 2016)의 경우 객체의 검출이 실패할 때 새로운 ID를 부여하여 추적을 진행하므로 객체의 연속적인 궤적 정보가 요구되는 협력주행 인프라 환경에 적용하기에는 어려움이 있다. 검출 정보 이외에 추가적인 생김새 정보를 활용한 연구(Hou, 2019)도 존재하였으나, 전체 객체 대상이 아닌 선별적인 객체에 대한 생김새 비교 작업을 수행하였음에도 불구하고 높은 연산량으로 인하여 여전히 높은 사양의 하드웨어를 요구함을 확인할 수 있었다.

차량 인식 및 추적 알고리즘

본 연구에서는 200ms 이내 초저지연 조건에서 도로 상의 교통 추적 정밀도를 높이고자 목표하고 있다. 이는 기존 신경망 대비 연산량을 감소시키면서도 동일한 교통량 추적 정밀도를 유지할 수 있는 신경망 구조 간소화와 최적화 방안을 제시하고자 한다. 또한, SORT 알고리즘의 움직임 예측 방식은 등가속도 기반의 단순화 움직임 모델로 대체하여 연산량을 감소시키고, 추적 신뢰도는 객체의 검출 빈도가 떨어지는 상황에서도 추적 정밀도 개선방안에 대해 제시한다.

1. 차량 객체 검출을 위한 신경망 구조 설계

최근 연구된 대표적인 다중 객체검출 알고리즘으로는 EfficientDet(Tan, 2020)과 Yolo-v4(Bochkovskiy, 2020) 등이 있다. 하지만 해당 알고리즘들은 Deep DenseNet 기반의 신경망 구조로 인하여 도로에 위치한 인프라 시스템에 적용하는 데, 많은 연산량이 발생하므로 교통량 추적에 적용하는 데 시간지연이 발생된다. 이에 본 연구에서는 파라미터의 활용률을 높이고 연산량을 줄인 OSANet 기반의 Scaled Yolo v4 신경망(Wang, 2021)으로 객체검출 알고리즘을 구성하였으며 전체적인 신경망의 구조는 Table 1과 같다.

Table 1.

The overall structure of a neural network

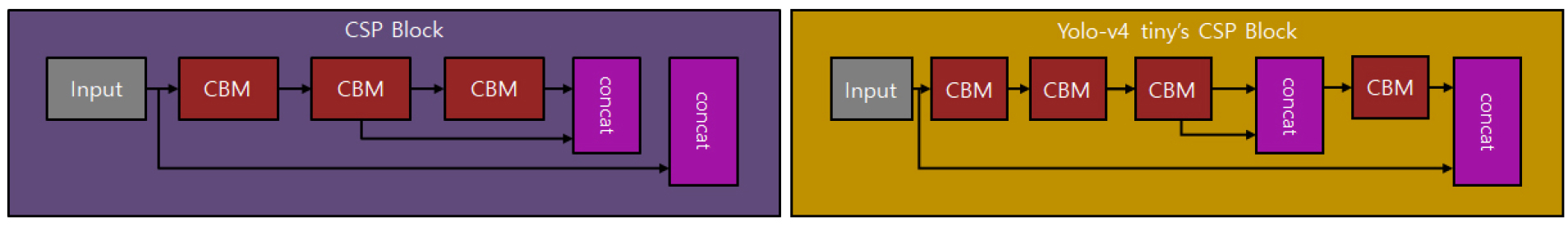

신경망 구성의 특징은 얕은 깊이의 신경망을 이용하여 충분한 특징을 확보함과 동시에 특징 지도의 가로, 세로 크기를 효율적으로 줄일 수 있도록 Max Pool 레이어를 이용하여 Backbone을 구성하였다. 신경망의 연산량을 감소시키기 위하여 기존 CSP 블록 내부의 Transition 단계를 제거하였으며 기존의 CSP 블록과의 차이는 Figure 8과 같다. 최종 객체 검출을 위한 Fully connected Layer는 총 2개 검출 피라미드로 구성하였다. 608×608 규모의 이미지 입력 기준, 입력 특징 지도는 19×19, 38×38이 된다.

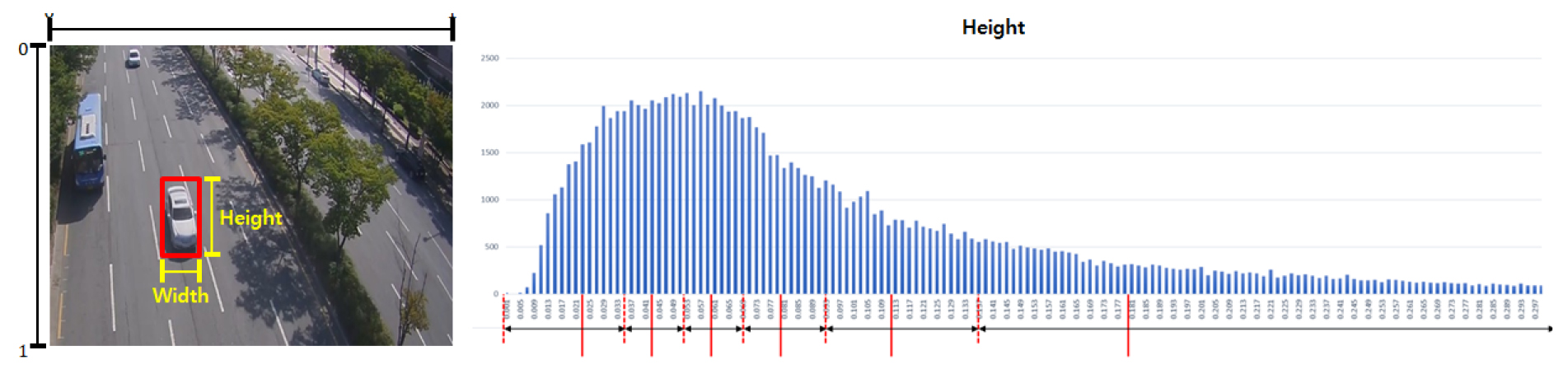

또한, 객체검출 단계에서 활용되는 Anchor Box의 크기를 최적화하기 위하여 실제 도로 CCTV 데이터에 나타난 차량의 라벨링 작업을 수행하였다. Figure 9와 같이, 차량의 너비와 높이는 이미지의 가로, 세로 크기를 1로 정규화 하여 변환하고 전체 차량을 객체의 높이 기준으로 정렬, 하위 99% 구간을 추출하여 6개의 Bin으로 나눈 평균을 구하여 Anchor Box의 크기로 사용하였다.

2. 차량 추적 알고리즘

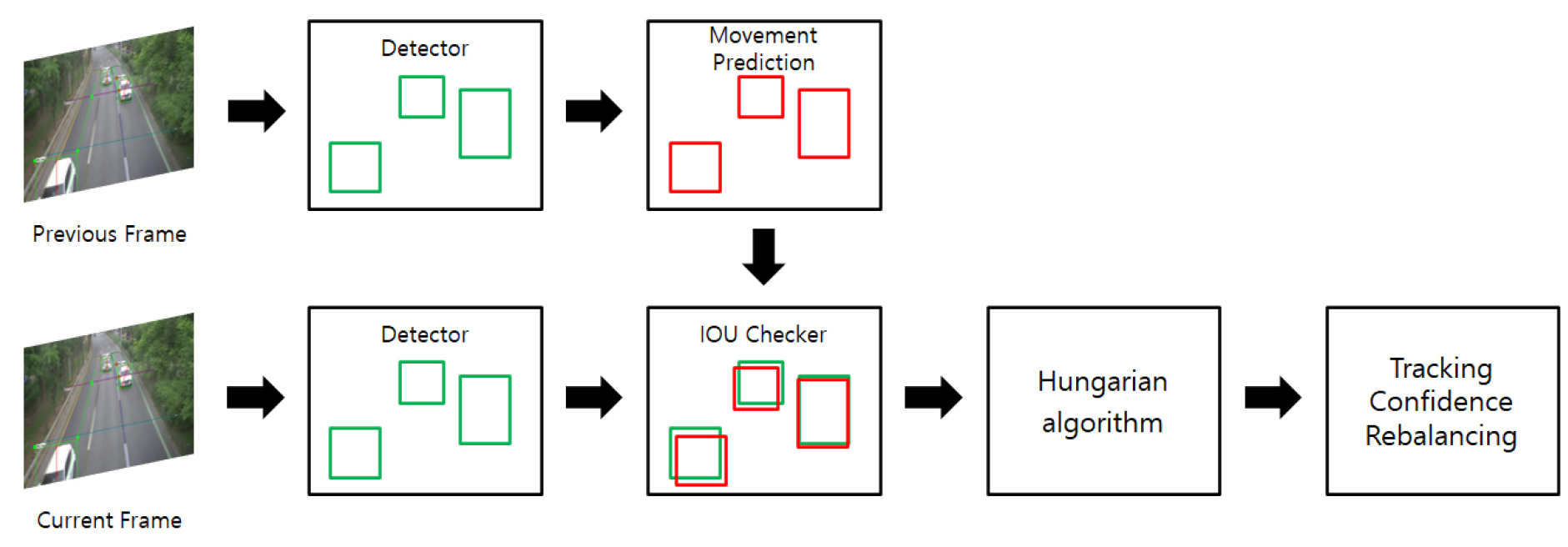

SORT(Simple Online and Realtime Tracking)의 경우 이전 프레임에서 추적 중이던 객체 움직임을 예측하기 위해 칼만 필터를 사용하였다(Alex Bewley et al., 2016). 하지만 이런 문제 해결은 영상에서 관측되는 객체의 수에 비례하여 칼만 필터의 연산이 가중됨을 확인할 수 있었다(Wojke, 2017). 따라서 본 연구의 객체 추적 알고리즘은 객체 움직임을 등가속도 모델로 한정하여 현재의 위치를 예측하도록 구성하고, 전체적인 객체 추적 알고리즘은 Figure 10과 같이 구성하였다.

등가속도 운동 모델을 이용하여 객체의 움직임을 예측하는 경우, 객체의 갑작스러운 움직임에 대한 예측 성능이 떨어지는 현상이 발생한다. 이 문제 해결은 최근 5개의 프레임을 이용하여 평균 속도를 구하여 현재 프레임에서 객체의 위치를 예측한다. 예측된 객체의 크기를 이전 프레임과 동일하게 설정하여 현재 프레임에서 새롭게 검출되는 객체들과의 IOU 값을 구하여 헝가리안 매칭으로 이루어진 두 경계 상자 사이의 거리, 값을 구하였다. 추적중인 객체가 새롭게 검출된 경계상자와 연속으로 매칭되지 못한 프레임의 수를 이라고 할 때, 현재 프레임에서의 추적 신뢰도 은 아래의 식과 같이 정의한다.

실험 및 검증

1. 실험 환경

교통량 추적 초저지연 고정밀도 개선에 대한 알고리즘의 성능 검증은 40개소 이상의 장소에서 촬영한 동영상을 바탕으로 개소별 100장 이상의 데이터를 추출하여 학습에 사용하였다. Car, Truck, Bus 3가지 클래스로 구분하여 객체를 라벨링하고 학습 데이터를 구축하였다. 또한 신경망 학습에 사용되지 않은 새로운 18개 장소의 실도로 영상에서 각각 100장의 검증용 데이터를 구축하였다. 이때 신경망의 Anchor Box 최적값을 구하기 위하여 라벨링 된 객체의 크기들을 바탕으로 그 값을 설정하였으며, 그 결과는 Table 2와 같다.

Table 2.

Average size of extracted vehicles

| Bin 1 | Bin 2 | Bin 3 | Bin 4 | Bin 5 | Bin 6 | |

| Height (%) | 2.45 | 4.45 | 6.27 | 8.55 | 2.53 | 24.37 |

| Width (%) | 2.14 | 3.46 | 4.63 | 6.21 | 8.59 | 12.86 |

| Height (%) | 15 | 27 | 38 | 52 | 76 | 148 |

| Width (%) | 13 | 21 | 28 | 38 | 52 | 78 |

2. 객체검출 알고리즘

객체검출 알고리즘의 성능 비교를 위하여 Dense Network인 Scaled YOLO v4 p5 모델과 YOLO v4 tiny 모델(Wang, 2021)을 동일한 데이터 셋을 이용하여 함께 학습하여 mAP(mean Average Precision)를 산출하였으며 그 결과는 Table 3과 같다. 검증 결과, 본 연구에서 제안한 알고리즘은 YOLO v4 tiny 모델 대비 9% 이상 연산량이 감소하였으며, 객체의 검출 성능 또한 Dense Network인 YOLO v4 p5 모델 보다 우수함을 확인할 수 있었다.

Table 3.

Neural network performance verification result by object

| BFLOPS | Car | Truck | Bus | mAP | |||||||

| TP | FP | AP | TP | FP | AP | TP | FP | AP | |||

| Scaled YOLO v4 p5 | 218.237 | 0.839 | 0.675 | 0.709 | 0.741 | ||||||

| YOLO v4 tiny | 14.512 | 0.884 | 0.612 | 0.718 | 0.741 | ||||||

| Proposed Algorithm | 13.114 | 0.878 | 0.648 | 0.759 | 0.762 | ||||||

연산 속도의 비교를 위해 Nvidia 사의 Jetson Xavier 모듈 및 Jetson NX 모듈에서 상기 신경망들을 동작, 한 프레임의 처리에 드는 시간을 측정하였다. 신경망마다 1920*1080 크기의 100장의 도로 이미지를 입력하여 검출 시간을 측정하여 평균 값을 구하였다. 실험 결과는 아래의 Table 4와 같으며, 본 논문에서 제안하는 신경망 구조가 낮은 연산량의 임베디드 환경에서도 실시간으로 활용 가능함을 확인할 수 있었다.

Table 4.

Average of object detection calculation time

| Jetson Xavier (ms) | Jetson Xavier NX (ms) | |

| Scaled YOLO v4 p5 | 219 | 441 |

| YOLO v4 tiny | 29 | 49 |

| Proposed Algorithm | 26 | 46 |

3. 차량 추적 알고리즘

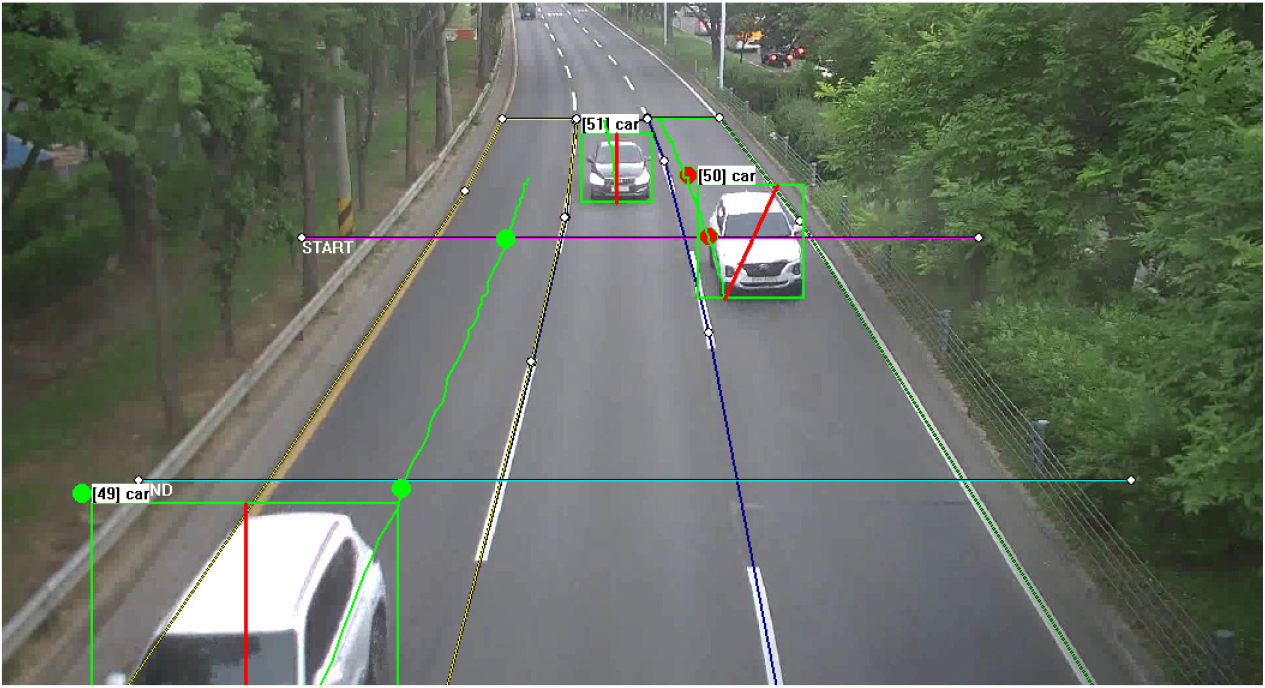

추적 알고리즘의 정확도 실험을 위한 차량의 추적 시작과 종료 영역을 Figure 11과 같이 설정하였다. 해당 구간을 지나가는 동안 추적 유지에 성공하는 경우 교통량을 계수하고, 평균절대오차백분율(MAPE)을 바탕으로 차량의 추적 알고리즘 성능을 측정하였다. i번째 분석단위시간의 기준값을 , i번째 분석단위시간의 평가대상장비 측정값을 , 분석단위시간 개수를 , 분석단위시간당 측정된 차량의 합을 교통량으로 정의하였을 때 평균절대오차백분율은 아래와 같이 구할 수 있다. 단, 기준 값이 0(zero)이고, 측정값이 0이 아닌 경우, 또는 100(%)-평균절대오차백분율(MAPE)이 음수(-)인 경우에는 결과를 “0”으로 산정하였다.

실험의 비교를 위한 참값은 동영상을 사람이 육안으로 계수하여 작성하였으며, 차량의 추적 시작 영역에서 종료 영역까지 새로운 ID를 부여하지 않고 추적에 성공한 경우에만 알고리즘을 통한 통행량으로 산출하였다. 추적 신뢰도에 따른 추적 정밀도 개선 정도를 확인하기 위하여, 객체의 검출에 실패하는 경우 새로운 ID를 부여하도록 기존의 SORT 방식의 추적 알고리즘을 구현하고, 객체의 검출 빈도를 조절하기 위하여 객체 검출 임계값을 각각 0.5와 0.9로 설정하여 비교 실험을 수행하였으며 그 결과는 아래의 Table 5와 6에 나타난 것과 같다.

Table 5.

Tracking object counting results – our methods

Table 6.

Tracking object counting results – without tracking confidence

동일한 신경망을 이용하되, 객체의 검출 임계값을 조절하여 영상에서 검출되는 객체의 수를 조절하였다. 본 논문에서 제안하는 추적 신뢰도를 적용하는 경우에는 객체의 검출이 간헐적으로 발생하더라도 정상적으로 객체의 추적을 유지하여 상대적으로 높은 통행량 정확도를 보였으며, 객체검출 임계값을 높이더라도 그 성능이 유지됨을 확인할 수 있었다. 하지만 추적 신뢰도를 사용하지 않고, 객체의 미 검지 시 새로운 추적을 이어가는 경우에는 상대적으로 낮은 통행량 정확도와 임계값의 상승에 따른 객체검출률 감소에 통행량 정확도가 영향을 받음을 확인하였다.

결론 및 향후 연구과제

본 연구에서는 초저지연으로 도로에 위치한 교통량 객체(승용차, 버스, 트럭)를 정확하게 인식할 수 있도록 기존의 신경망 대비 연산량을 감소시키면서도 동일한 성능을 유지할 수 있도록 Yolo-v4의 신경망 구조 간소화 및 최적화 방안을 제안하였다. 본 제안 알고리즘은 Backbone 구조 간소화 및 Anchor Box의 최적화 작업을 통해 연산량을 감소시키면서도 객체의 검출 성능을 유지하였으며, 제안하는 기술이 실시간으로 사용 가능함을 실험을 통해 확인하였다. 또한, 기존 SORT 알고리즘의 움직임 예측 방식을 등가속도 기반의 단순화된 움직임 모델로 대체하여 연산량을 감소시키고 추적 신뢰도를 정의하여 객체의 검출 빈도가 떨어지는 상황에서도 추적 정밀도를 개선할 수 있는 방안을 제시하였으며, 선형적인 움직임을 보이는 객체들이 주로 존재하는 도로상에 적용 가능함을 확인하였다. 본 연구에서 제안하는 기술은 기존 기술 대비 상대적으로 낮은 사양의 하드웨어에 적용하더라도 실시간으로 동작할 수 있다. 또한, 노변에서 데이터를 취득하여 분석 서버로 전송 후 응답을 받던 기존 방식과 달리 현장에서 분석을 수행함으로써, 데이터의 왕복에 드는 물리적인 지연시간이 존재하지 않으므로 향후 자율주행 자동차에 데이터를 제공할 수 있는 협력주행 인프라 구축에 활용할 수 있을 것으로 기대된다.

하지만 본 논문에서 사용된 CCTV의 높이는 6-12m 정도인데, 상대적으로 카메라의 높이가 낮은 환경에서 앞쪽에 위치한 큰 객체(버스, 트럭 등)이 발생하는 경우 뒤쪽에 있는 객체들의 추적을 이어가는데 어려움이 있을 것으로 예상된다. 해당 문제를 해결하기 위해서는 단순한 움직임 예측이 아닌, 생김새를 기반으로 사라진 객체의 외양 정보를 이용하여 사라졌던 객체의 추적을 복원하는 방안에 대한 추가 연구가 필요할 것으로 판단된다. 또한, 추적 알고리즘에 있어 객체의 이동을 선형적으로 가정한 개발은, 사람이나 야생동물 등 비선형적인 움직임을 추적하는데 어려움이 있어 해당 부분에대한 보완 연구가 필요하다. 또한, Choi(2021)의 위험도 평가에 근거하면 실제 자율주행 자동차와의 자율협력주행을 위해서는 카메라 센서의 정확한 객체의 위치와 속도를 산출할 수 있는 솔루션이 필요하다.